PPIO解锁QwQ-32B:小参数大能量,推理性能亮眼!

QwQ 系列推理模型在 AI 界久负盛名。

2025 年 3 月 6 日凌晨,阿里巴巴正式发布并开源了其中极具潜力的 QwQ-32B 模型。与传统的指令调优模型相比,QwQ 具备卓越的思考和推理能力,能够在下游任务中实现显著增强的性能,尤其是在解决困难问题方面表现突出。

Ⅰ. 模型简介:中型推理的实力担当

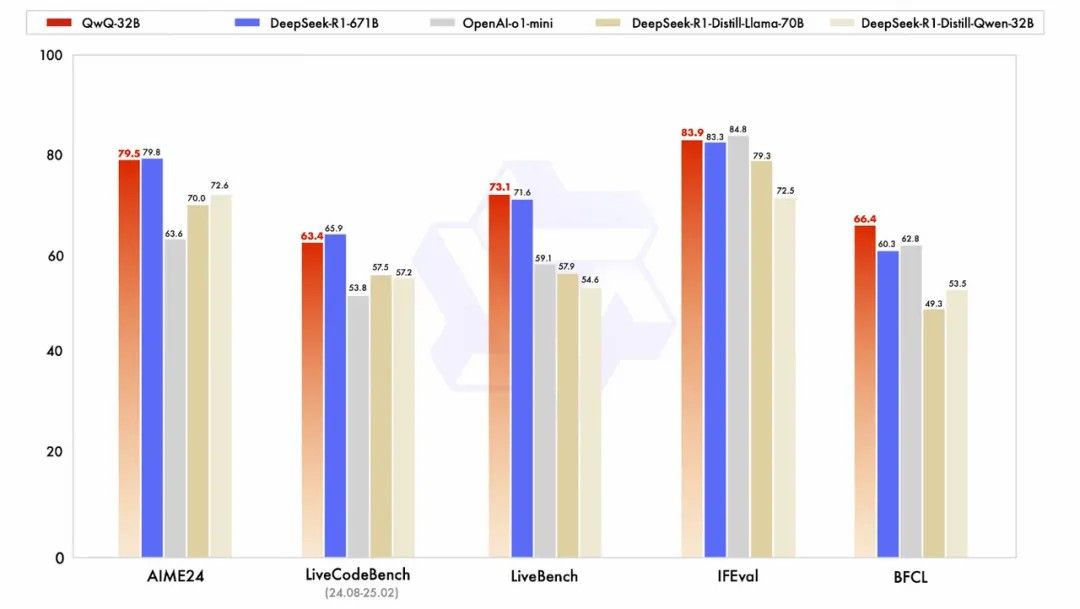

QwQ-32B 是一款 320 亿参数的中型推理模型,在与最先进的推理模型,如 DeepSeek-R1、o1-mini 的对比中,也能展现出极具竞争力的性能。

该模型在一系列评估数学、编码和结构化推理的基准上进行了测试。

在 AIME24 数学测试、LiveCodeBench 编码测试中,QwQ-32B 均紧追 DeepSeek - R1 。在 IFEval 测试、LiveBench、BFCL 通用技能评估方面,QwQ-32B 分别以 83.9 、73.1 、66.4分高于 DeepSeek - R1。

Ⅱ. 模型应用:PPIO打造优质体验

作为深耕 AI infra 领域的行业先锋,PPIO派欧云上线 QwQ-32B 模型,旨在为广大用户提供更高效、更智能的 AI 解决方案。

在价格方面,QwQ-32B 模型具有相当的吸引力,输入仅¥1 / 百万 tokens,输出仅¥3.5 / 百万 tokens。同时,其 context 长度可达 32k,能够获取更丰富的上下文信息,从而做出更精准、全面的判断与解答。

平台支持针对该模型的 function call 功能,提供了更高的灵活性,能更高效地将模型融入各类应用场景之中 。

模型结果对比:

DeepSeek - R1 分点明确,公式与文字结合紧密,以标准 “解析” 形式呈现;

QwQ - 32B 采用 “自问自答”,穿插大量计算细节,思考过程外显,适合教学场景。

准确性方面,两者均正确解题。

👉在线体验:https://ppinfra.com/llm/qwen-qwq-32b

👉API 文档:https://ppinfra.com/docs/model-api/reference/llm/