PPIO上线阿里Wan 2.6:制作电影级AI视频,对标Sora2

今天,PPIO 上线阿里最新发布的 Wan 2.6 视频生成模型。

Wan 2.6 是一个用于生成高质量视频和图像内容的高级多模态 AI 模型,将文本、图像、视频和音频整合到一个无缝框架中,提供文本转视频、图像转视频和文本转图像等功能。

Wan 2.6 可生成 24fps 的 1080p 视频,具有原生音画同步和精确的口型同步。Wan 2.6 支持多语言内容创作,适用于社交媒体、营销、电影制作和电子商务应用。

Wan 2.6 的主要优势有两个。

一是增强生成质量。Wan 2.6 可以与 Sora2 竞争,在参考视频生成、多镜头叙事能力、生成质量和视频时长方面带来了显著改进。

二是本地音画同步。Wan 2.6 支持本地音画同步和精确的口型同步,适用于自然角色动画和对话,是专业内容创作的理想选择。

现在,你可以到 PPIO 网站调用 Wan 2.6 了,文档如下:

- Wan 2.6 文生视频:https://ppio.com/docs/models/reference-wan2.6-t2v

- Wan 2.6 图生视频:https://ppio.com/docs/models/reference-wan2.6-i2v

- Wan 2.6 参考视频:https://ppio.com/docs/models/reference-wan2.6-v2v

# 01 在 PPIO 调用 Wan 2.6 模型API

如果你想在 PPIO 调用 Wan 2.6 模型,主要有三个步骤:

一是到 PPIO 平台注册并创建 API;

二是调用 API。由于 Wan 2.6 是一个异步 API,调用 API 只会返回异步任务的 task_id;

三是通过 task_id 获取最终的视频生成结果。

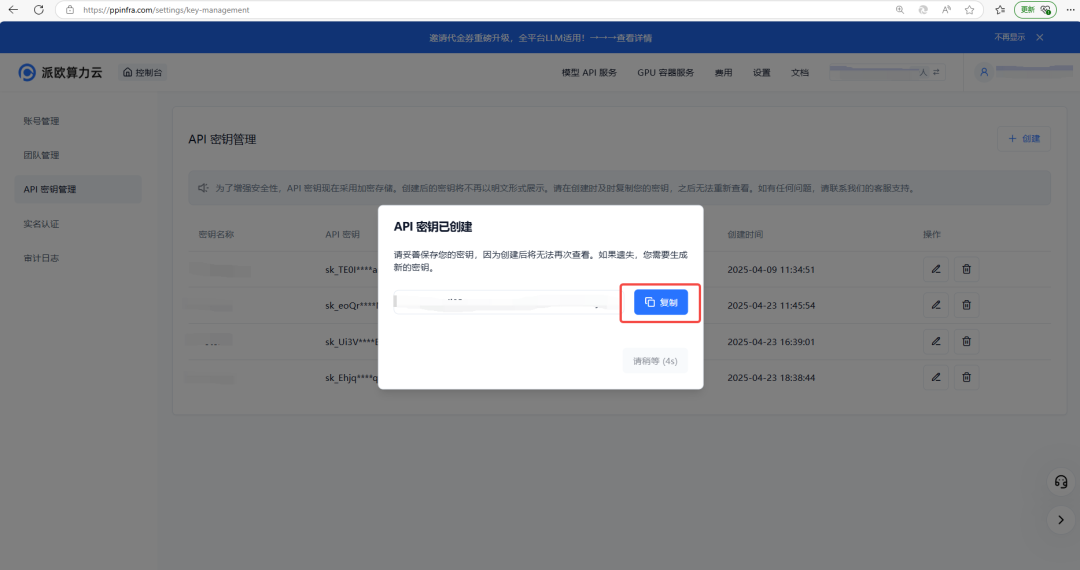

(1) 获取并保存【 API key 】

注册并登录 PPIO,然后打开 API 密钥管理页面,点击【创建】按钮,输入自定义密钥名称,生成 API 密钥。

!!!注意:密钥在服务端是加密存储,请在生成时保存好密钥(比如记录在备忘录里);若遗失密钥,可以在控制台上删除并创建一个新的密钥。

以文生视频为例,到文档—模型服务 API 手册获取 Wan 2.6 的 URL:

https://ppio.com/docs/models/reference-wan2.6-t2v

(2)通过向 Wan 2.6 API 发送 POST 请求来生成 task_id

请求:

curl --request POST \

--url https://api.ppinfra.com/v3/async/wan2.6-t2v \

--header 'Authorization: <authorization>' \

--header 'Content-Type: <content-type>' \

--data '

{

"input": {

"prompt": "<string>",

"audio_url": "<string>",

"negative_prompt": "<string>"

},

"parameters": {

"seed": 123,

"size": "<string>",

"audio": true,

"duration": 123,

"shot_type": "<string>",

"watermark": true,

"prompt_extend": true

}

}响应得到 task_id

{

"task_id": "{返回的 Task ID}"

}(3)使用 task_id 获取输出视频

2xx 范围内的 HTTP 状态码表示请求已成功接受,而 5xx 范围内的状态码表示内部服务器错误。你可以在响应的 videos 字段中获取视频 url。

请求:

curl --request GET \

--url https://api.ppinfra.com/v3/async/task-result \

--header 'Authorization: <authorization>' \

--header 'Content-Type: <content-type>'响应:

{

"extra": {

"seed": "<string>",

"debug_info": {

"request_info": "<string>",

"submit_time_ms": "<string>",

"execute_time_ms": "<string>",

"complete_time_ms": "<string>"

}

},

"task": {

"task_id": "{返回的 Task ID}",

"status": "<string>",

"reason": "<string>",

"task_type": "<string>",

"eta": 123,

"progress_percent": 123

},

"images": [

{

"image_url": "<string>",

"image_url_ttl": 123,

"image_type": "<string>"

}

],

"videos": [

{

"video_url": "<string>",

"video_url_ttl": "<string>",

"video_type": "<string>"

}

],

"audios": [

{

"audio_url": "<string>",

"audio_url_ttl": "<string>",

"audio_type": "<string>",

"audio_metadata": {

"text": "<string>",

"start_time": 123,

"end_time": 123

}

}

]

}现在,你可以到 PPIO 进行体验了。新用户还可以用邀请码注册【24CGOJ】领取代金券。企业级用户可以扫码获取企业级权益与报价。