新增4大GPU Instance集群,PPIO全球算力网络拓展至9个国家

图形处理器(GPU, Graphics Processing Unit)最初设计用于加速图形渲染,广泛应用于视频游戏市场的图形、图像、视频内容渲染领域。

过去几年,随着AI训练的爆发,GPU的应用也不再局限于图像领域,在AI推理、训练等领域重要性持续提升,并逐步成为支撑现代人工智能发展的核心算力基础设施。

PPIO派欧云提供的GPU容器实例服务,具备按需付费和开箱即用的特点,可满足 AI推理、AI 训练、云渲染等计算密集型场景的需求。

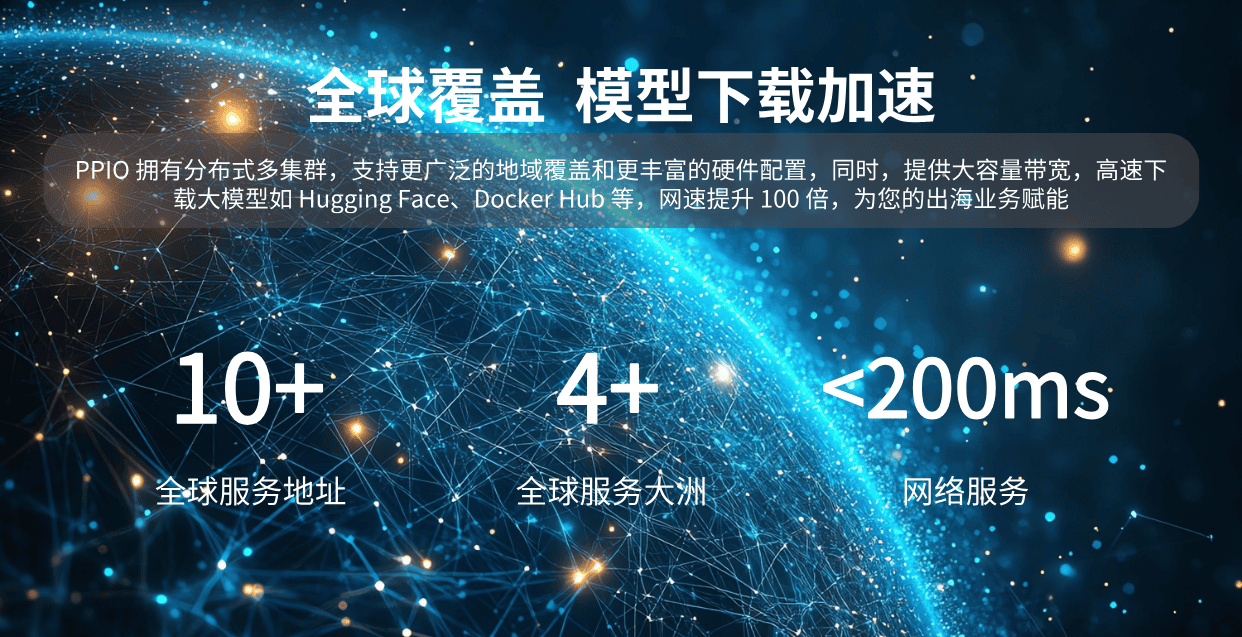

近日,PPIO在印度、英国、阿联酋、巴西新增GPU Instance 集群,将集群覆盖国家提升至9个,让全球更多国家及地区用户便捷调用GPU 算力。

新增4大集群,累计覆盖全球9个国家及地区

此前,PPIO已在中国、日本、新加坡等5个国家建设GPU Instance 集群,此次新增4大集群,将PPIO所建设的GPU Instance 集群覆盖国家拓展至9个,进一步完善了PPIO的全球化算力网络布局。

多元显卡类型,快速灵活调用

此次建设的GPU Instance 集群,包含RTX4090、H200、A100等多款高性能卡型,用户可以通过最佳硬件选型和推理优化加速技术,实现资源成本的最优化。

并且, PPIO提供的GPU 容器实例配备开箱即用的公共镜像,支持当前主流模型和框架,用户可以无缝集成,提升开发效率。同时支持从本地导入自定义镜像,满足用户对于应用环境快速部署、灵活管理的需求。

通过构建地理分布广泛、技术架构领先、服务模式灵活的GPU算力网络,PPIO正在突破传统云计算的地域边界,让全球创新者都能轻松调用算力资源。