PPIO发布AI报告:2025年上半年国产大模型调用量十大趋势

2025年上半年,各种现象级智能体应用层出不穷,Manus、Flowith、扣子空间、Lovart、MiniMax Agent、Kimi Deep Research 等等。

智能体应用爆发背后,证明了大模型的智能水平已经达到相当可靠、可用的阶段。

其中,开源模型发展迅速,在性能上已经整体逼近甚至追平闭源模型,以 DeepSeek R1、Qwen3-235B-A22B 、Kimi K2 为代表的模型已经跻身全球 top 级模型。同时,开源模型大大降低了模型成本,AI 推理成本正以每年 10 倍的速度降低。

PPIO 提供国内主流开源模型服务,包括 DeepSeek、阿里 Qwen、MiniMax、Kimi、智谱 GLM 等,是国内开源模型服务最全面的 AI 推理云平台之一。根据 PPIO 平台的大模型 tokens 调用量,我们总结了 2025 上半年国内大模型十大趋势。

如果你对本 AI 趋势报告感兴趣,可以扫码下载报告原文。

趋势一:

DeepSeek 与 Qwen 分别占据半壁江山,是国内最受欢迎的两大开源模型

去年开源模型的影响力远没有今年大,很多人也并不认为开源模型的性能可以与闭源模型媲美。但 DeepSeek 的出现改变了这一局面。

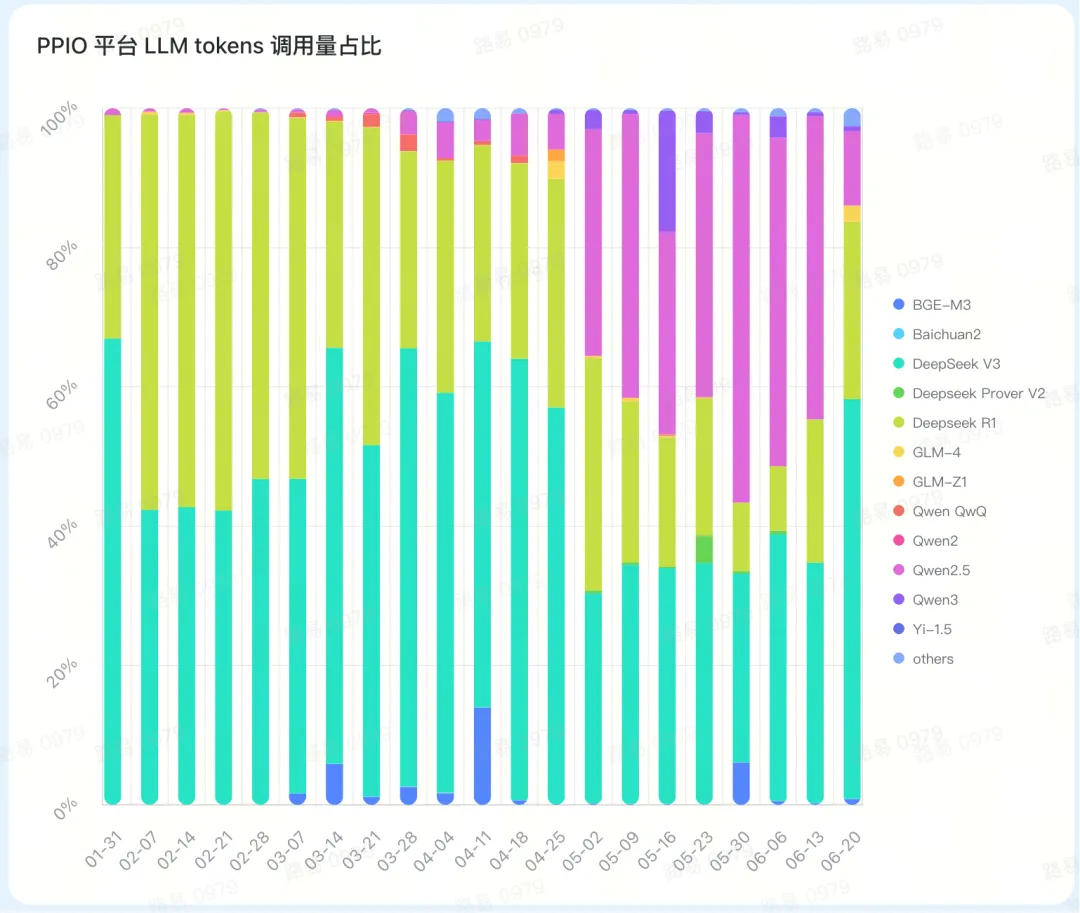

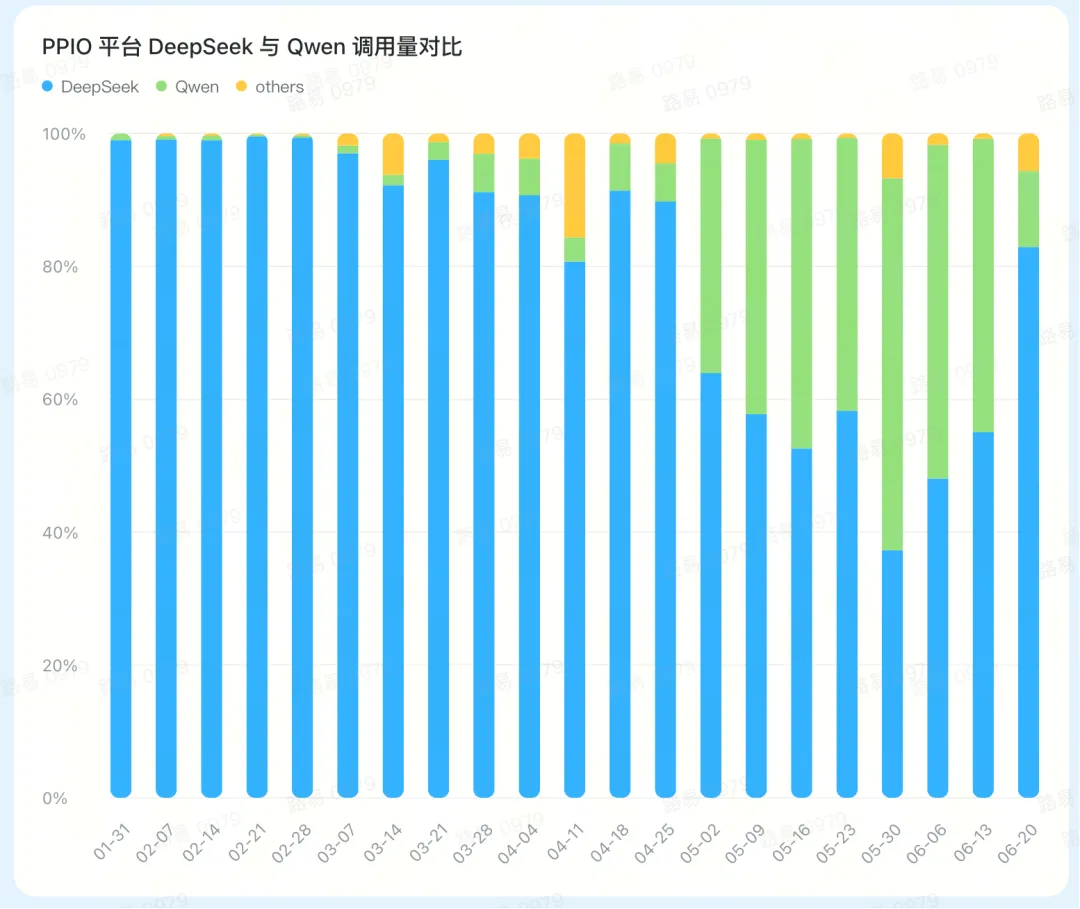

DeepSeek 有两个大版本,一是 base 模型 V3,首发于 2024 年 12 月,并在 2025 年 3 月 24 日发布更新版本;二是推理模型 R1,首发于 2025 年 1 月,并在 2025 年 5 月 28 日发布更新版本。2025 年第一季度,DeepSeek 模型一枝独秀,在 PPIO 的使用占比高达 99%。直到 5 月份后,DeepSeek 的使用量占比开始有所下降,主要是因为更多优秀模型出现,用户对于模型的选择更加多元化了。

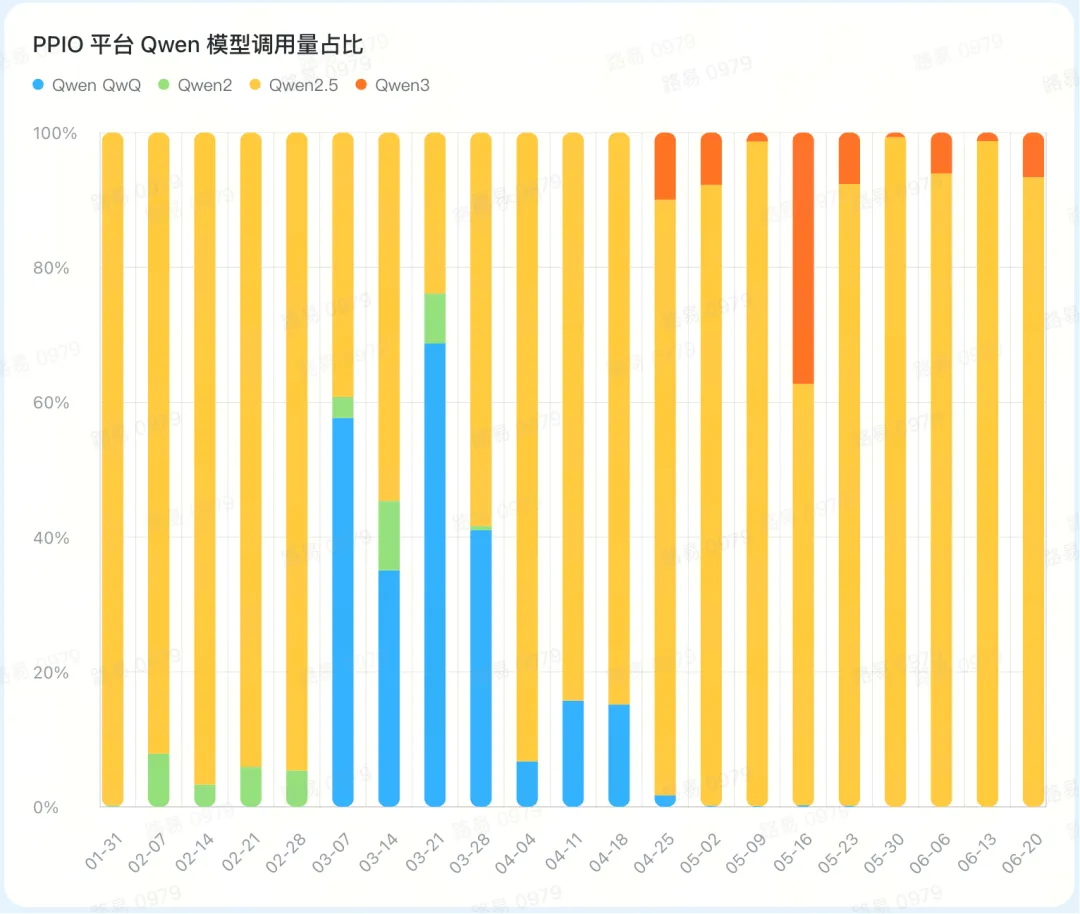

Qwen 就是其中的一个代表。PPIO 目前上线了 Qwen 的三个系列——Qwen2、Qwen2.5 和 Qwen3,前两者是 2024 年发布的模型,Qwen3 在今年 4 月 29 日首发上线 PPIO 。从 2025 年第二季度开始,PPIO 平台的 Qwen 模型的使用量开始高速增长,到 5 月下旬时调用量占比超过一半,最高时达 56%,与 DeepSeek 一同称为最受欢迎的两大开源模型。

趋势二:

尽管 DeepSeek R1 为代表的推理模型引领了强化学习的技术范式,但 DeepSeek V3 这一类非推理模型却更受欢迎

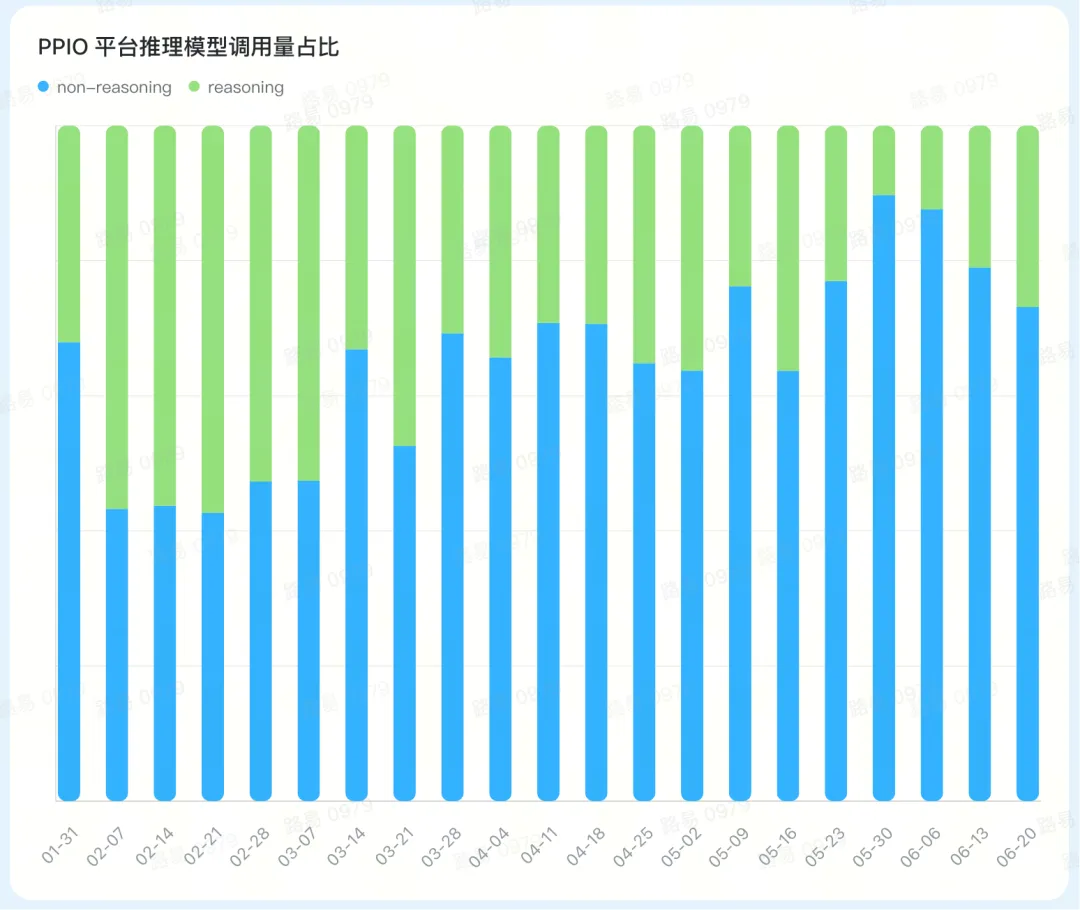

推理模型始于 OpenAI o1 模型,特指使用强化学习、思维链(CoT)等技术来训练的模型,可以将复杂任务场景通过多步骤推理生成答案,思考时间越长,模型性能越强。PPIO 平台上线的推理模型包括 DeepSeek R1、Qwen QwQ、Qwen3 系列、GLM Z1 等。

2025 年 2 月份,推理模型受到广大 AI 开发者的青睐,其全平台的使用量占比保持在 50% 以上。但从 3 月份开始,非推理模型的使用量反超推理模型,并一直延续至今。

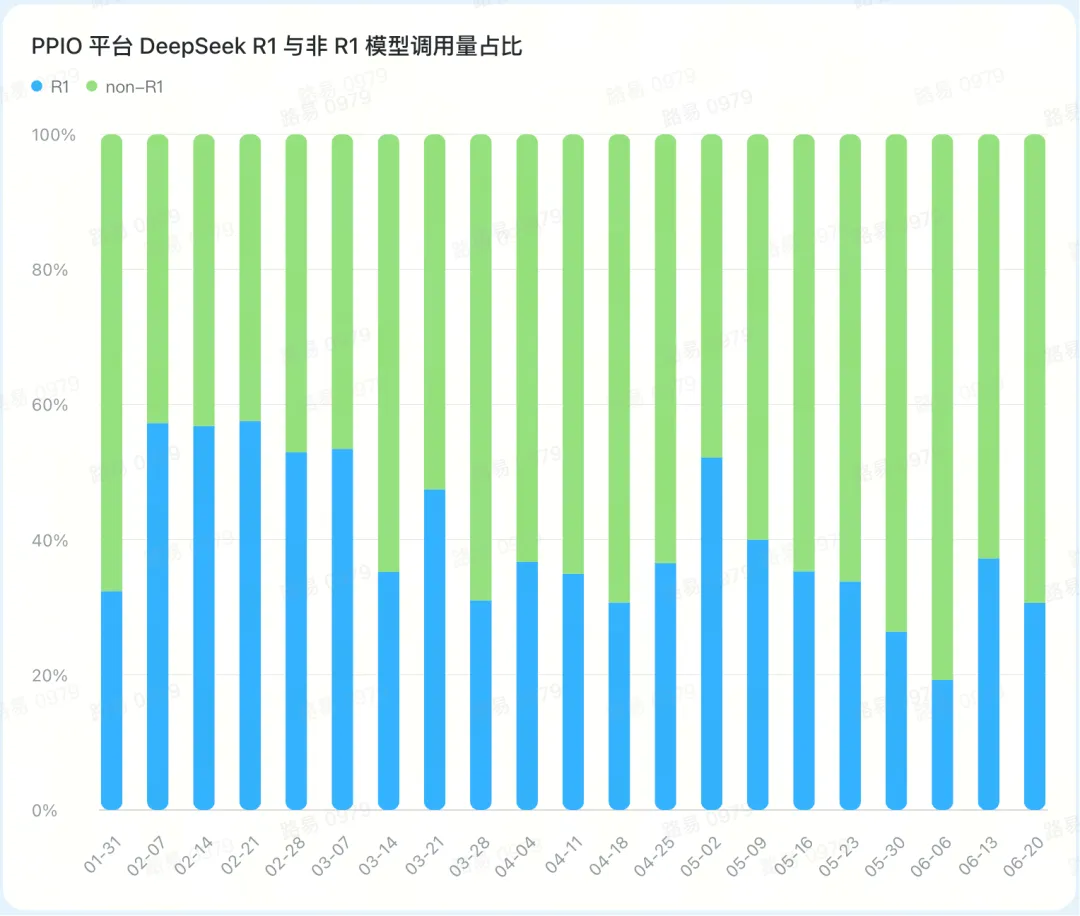

这一现象在 DeepSeek 的推理模型 R1 和非推理模型 V3 的调用量中也得到了印证。2025 年 2 月份,R1 在 DeepSeek 模型中的 tokens 调用量要高于 V3,占比超过50%。但从 3 月份开始,R1 之外的非推理模型 tokens 调用量逐渐上升,并长期保持在 60% 以上。

DeepSeek V3 比 DeepSeek R1 更受欢迎,这一现象背后的原因在于不同模型适用于不同的用户需求。

DeepSeek V3 这一类基础模型适用于日常对话、文本生成、多语言处理等高频需求,用户面广,使用门槛低,而且这一类应用场景通常并不需要复杂的推理过程;而 DeepSeek R1 专攻数学竞赛、代码逻辑等深度推理任务,而且由于深度推理需要消耗更多算力,输出成本更高,R1 百万 tokens 成本大约是 V3 的 2 倍左右。

趋势三:

DeepSeek 的数学模型、蒸馏模型的用户使用量较小,更大的意义在于推动行业研究

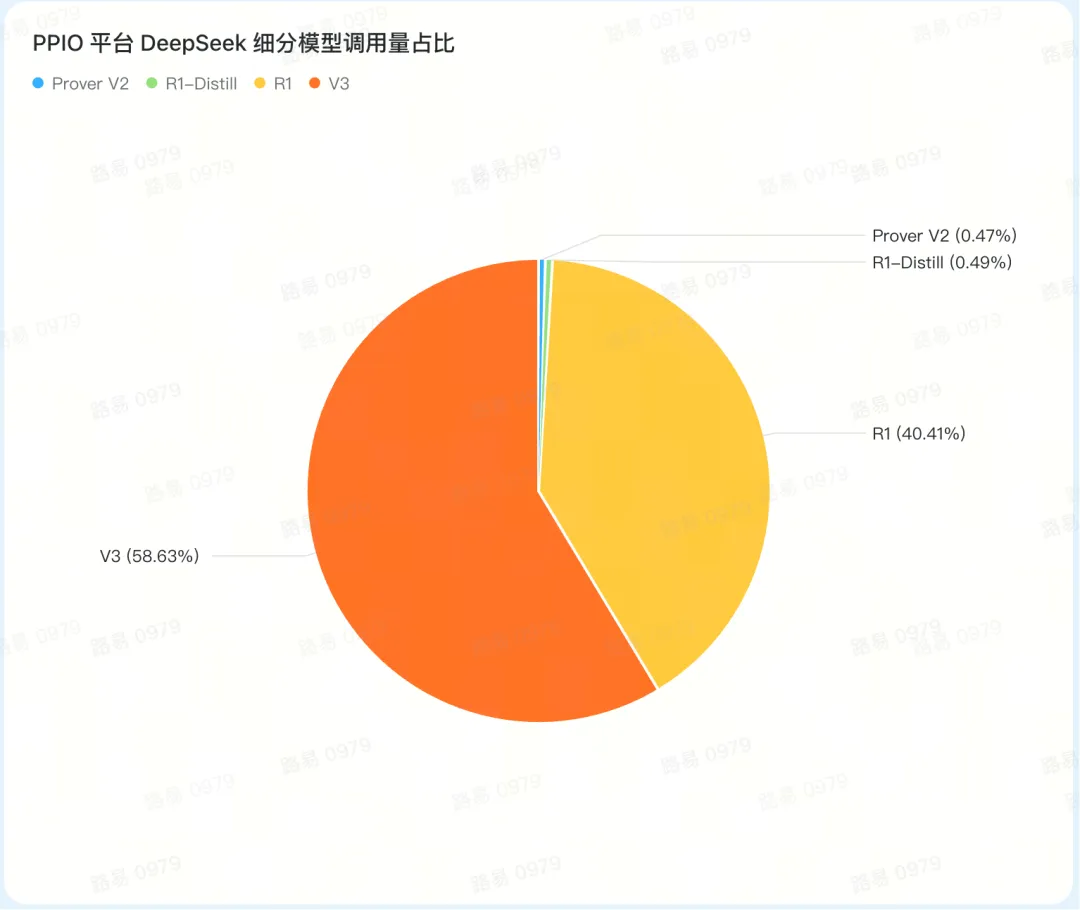

在 V3 与 R1 两大主力模型之外,DeepSeek 还开源了 Prover V2 数学模型,以及基于 Qwen 等基础模型的 R1 蒸馏模型。

Prover 是 DeepSeek 专门为数理逻辑与高复杂度任务而设计的数学模型,PPIO 在 4 月 30 日 首发上线了 Prover V2 671B;R1 蒸馏模型则是基于 Qwen 模型而蒸馏的 1.5B、7B、14B、32B 四个不同型号的模型,在数学基准测试上优于 GPT-4 和 Claude-3.5-Sonnet,甚至在多项能力上对标 o1-mini,PPIO 也在第一时间部署上线。

由于这两个系列的模型面向的用户场景较为垂直,相比 V3 与 R1 的使用量较小,仅占 DeepSeek 系列的 1% 。不过,这两款模型对于推动 AI 行业的基础研究有着重要的意义。

趋势四:

免费的 Qwen 2.5 调用量远高于性能更强的 Qwen 3,说明相比模型性能,价格依然是用户选型最关心的因素之一

Qwen 是国内最早的开源模型,生态布局广泛。在 2025 年 Hugging Face 的全球开源大模型榜单中,排名前十位的模型全是基于 Qwen 系列二次开发的。

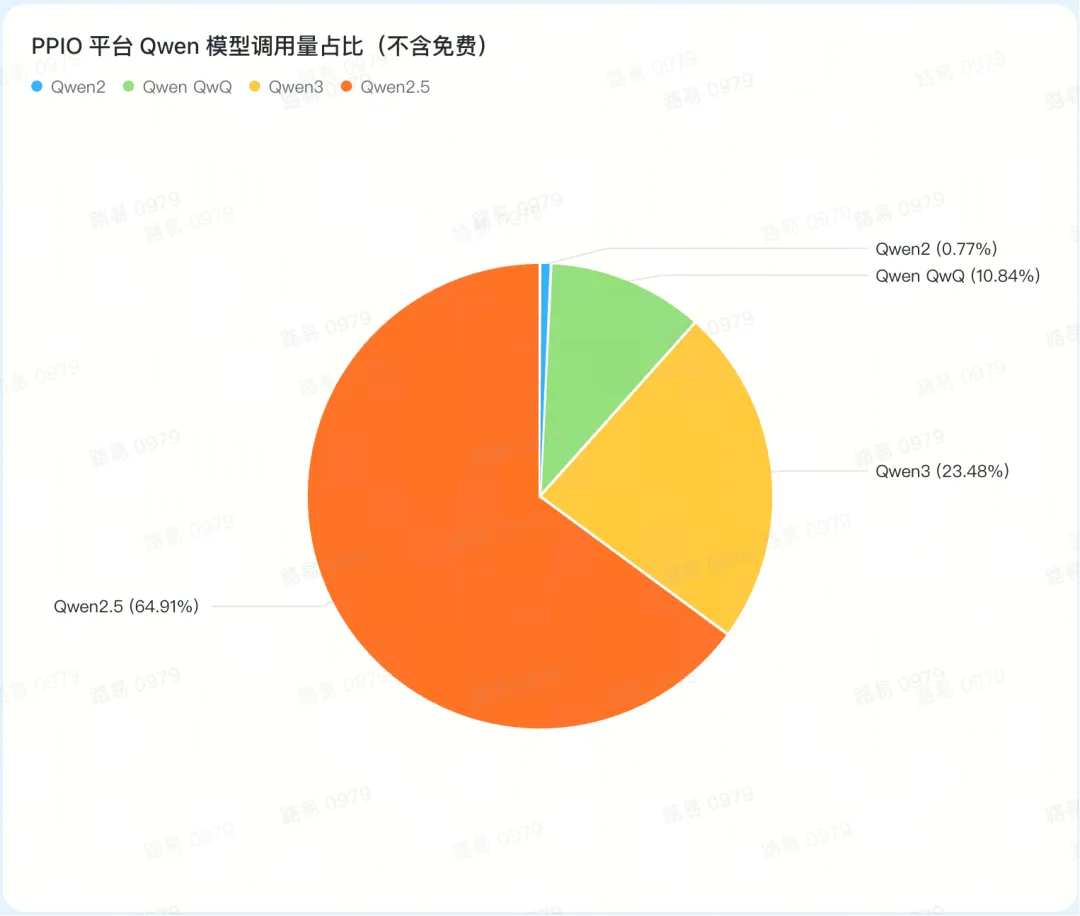

在 PPIO 平台的 Qwen 模型中,最受欢迎的是 Qwen2.5。PPIO 在 4月下旬针对 Qwen2.5-7B-instruct 等模型开放限时免费活动,该系列模型的 tokens 消耗激增,整体消耗占 Qwen 系列整体的 90% 以上。即使在 Qwen3 发布后,Qwen 2.5 依然保持了强劲的用户需求。

如果抛开免费模型,Qwen3 的 tokens 消耗量占据 Qwen 付费模型的 23.48%,在 5 月中旬的使用量一度达到 37%。Qwen3 在业内率先支持混合思考模式,支持 119 种语言和方言,针对模型编码和代理能力做了重点优化,并增强了对 MCP 的支持。

趋势五:

在图片生成模型中,文生图与图生图的调用量占比约为 9:1

PPIO 平台不仅提供大语言模型 API 服务,也提供图像与视频生成等多模态 API 服务,但在不同场景用户有不同的使用偏好。

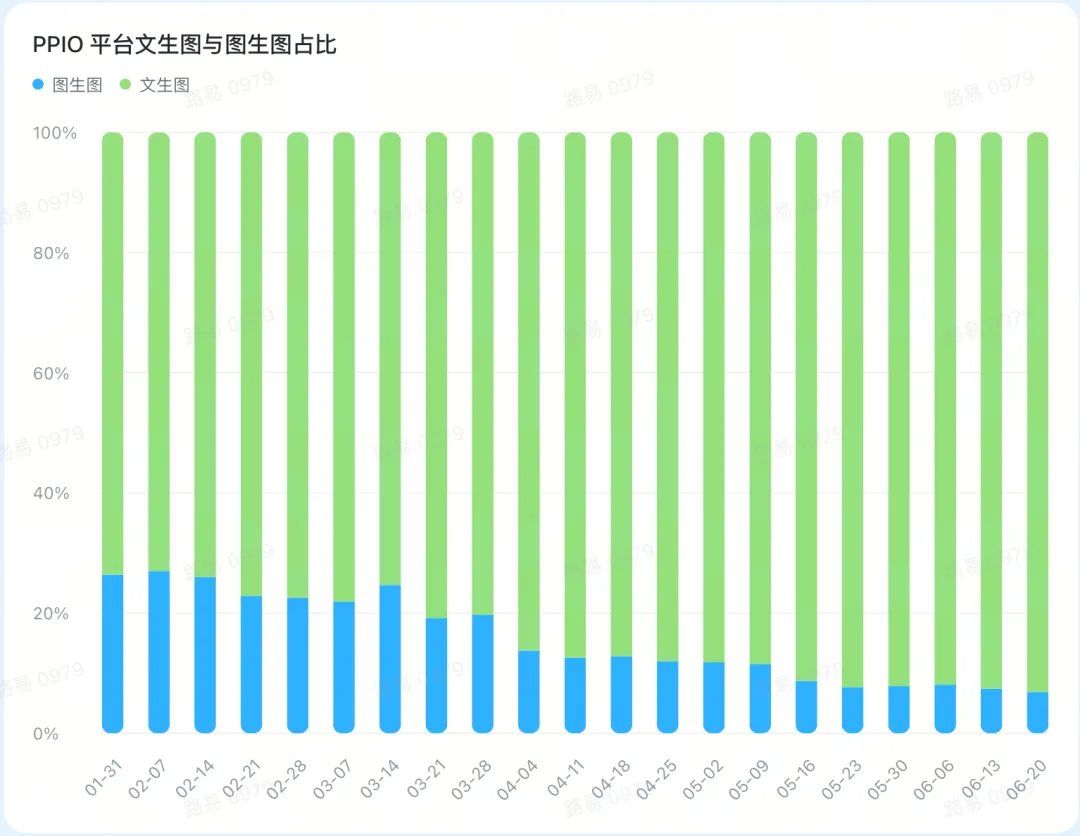

在生图领域,用户更喜欢使用文生图模型而非图生图模型。2025 年上半年,文生图模型的使用占比从 1 月份的 70% 增长到 6 月份的 90%。

相比图生图,文生图的创作门槛更低,文字描述可以更加精准地传达用户的想法与创意,并为用户提供更多的创意灵感。而且,文生图模型经过大量的数据训练,能够生成具有较高美学价值和质量的图像。

趋势六:

在视频生成模型中,文生视频与图生视频的调用量约为 1:9

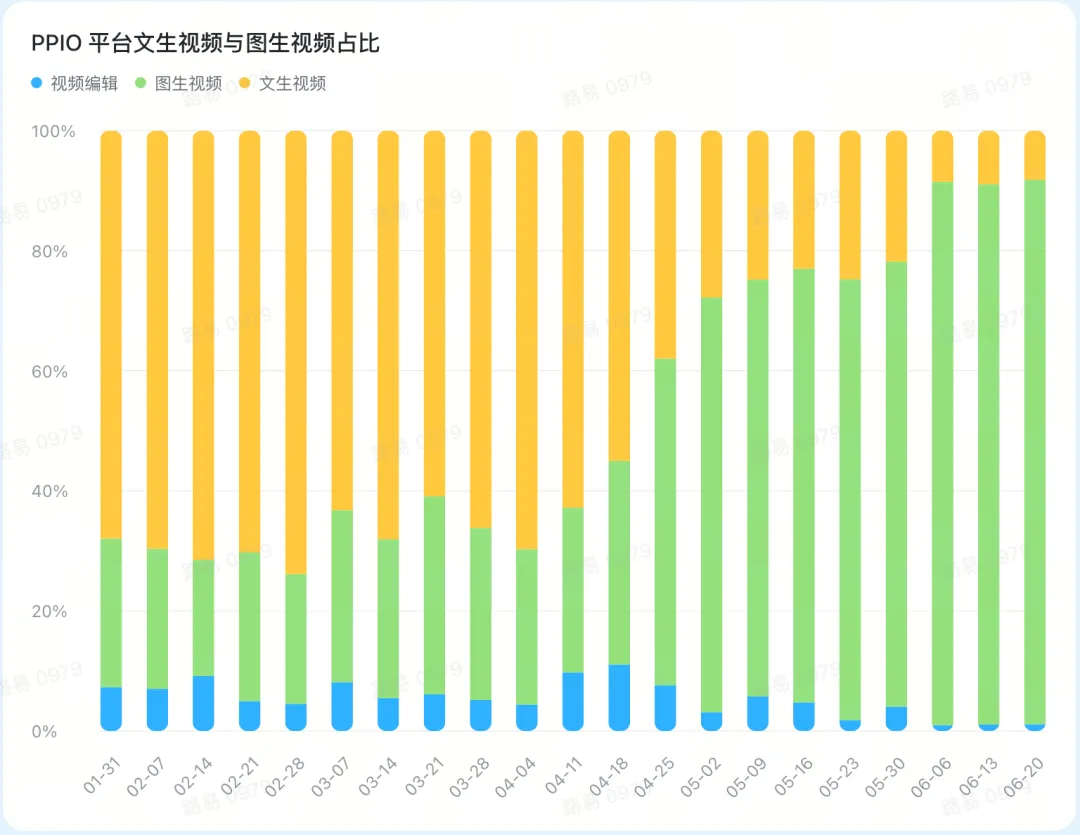

视频生成模型的用户使用习惯与图片生成模型恰恰相反,用户更加侧重于图生视频而非文生视频。图生视频模型的使用占比从 1 月份的 20% 左右,增到到 6 月份的 90% 以上。

图片生成视频模型的优势在于可控性更高,稳定性更好。相比文生视频常见的不确定性和难以控制的结果,图生视频模型能够更好地保证视频生成的质量和连贯性,同时也符合视频创作者的从业习惯和工作流程。在视频生成领域常见的工作流是,先用文生图模型生成图片,再用该图片生成视频。

趋势七:

Stable Diffusion XL 逐渐替代 Stable Diffusion 1.5,成为最受欢迎的图片生成模型基础架构

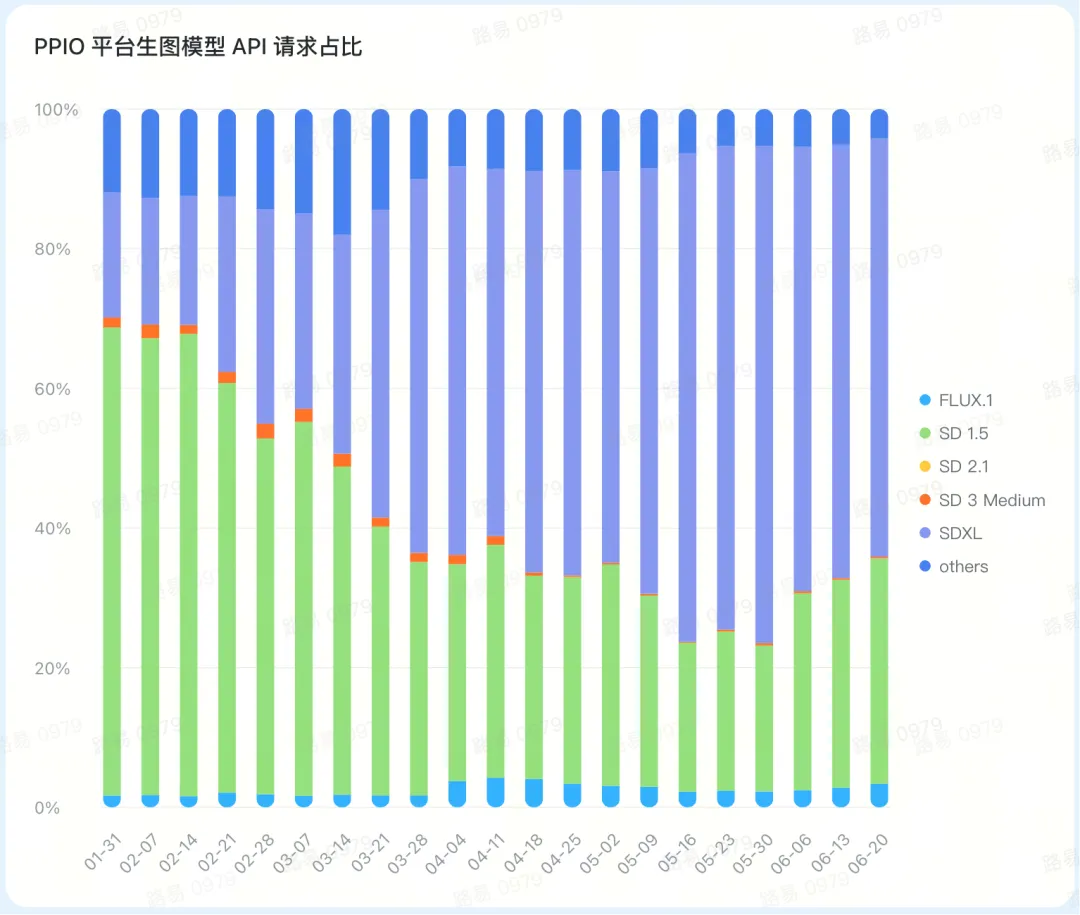

在生图领域,Stable Diffusion 1.5 与 Stable Diffusion XL 是两大最受欢迎的生图模型基础架构,有大量模型基于这两大架构进行二次微调,合计占据平台使用量的80%以上。其中,SD1.5 可支持二次元、卡通与写实风格,SDXL 更适合写实、摄影、插画等细腻风格。

从 3 月下旬开始,SDXL 系列模型使用量迅速增长,反超 SD 1.5系列模型。SD 1.5 系列模型的使用量在 2 月份高达65%左右,但到5月份已经降低到 22% 左右;SDXL 系列模型的使用量在 2 月份为 18% 左右,到 5 月份已经增长到 70%。

究其原因,SDXL 由于参数量更大且采用 Base 模型和 Refiner 模型组合,生成图像细节、色彩、对比度更优,生成图片细节丰富,对自然语言理解更强,社区支持和插件兼容性也逐渐提升。

Flux.1 模型的整体占比在 3% 左右,未见有明显的增长。

趋势八:

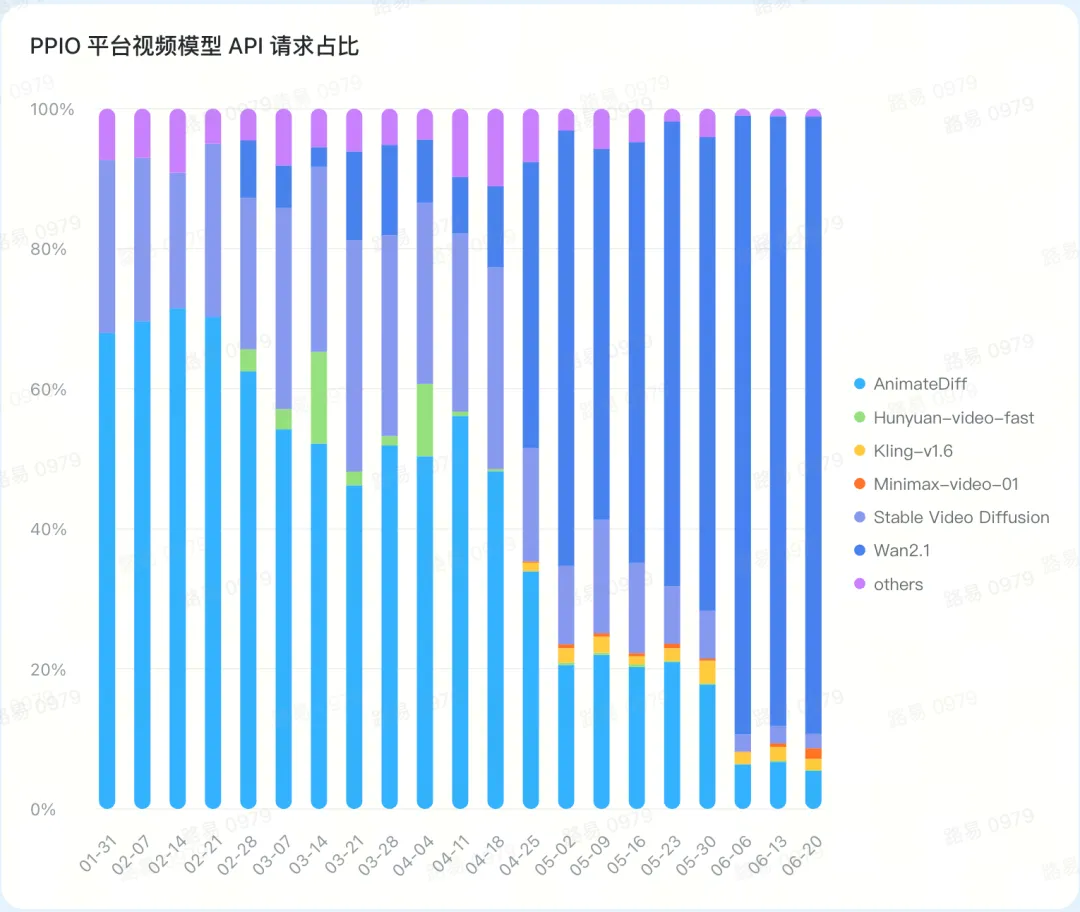

阿里万相是国内最受欢迎的开源视频模型

在 2 月份,视频生成模型主要有两类:一是文生视频的 AnimateDiff,这是基于 Stable Diffusion 的动画生成工具,使用量占比大约在70%左右;二是图生视频的 Stable Video Diffusion,使用量占比大约在20%左右。

从 3 月份开始,腾讯的开源视频模型 Hunyuan Video 与阿里的开源视频模型 Wanxiang(万相)上线后,国内开源视频模型开始高速增长。到 6 月份,阿里 Wanxiang 使用量占全平台的 80%以上,成为 PPIO 平台最受欢迎的国产视频开源模型。

6月份,PPIO 首发上线 MiniMax-Hailuo-02 视频模型,这是全球范围内图生视频领域排名第二的 SOTA 模型,上线第一周就斩获了 1.5% 的使用量。

趋势九:

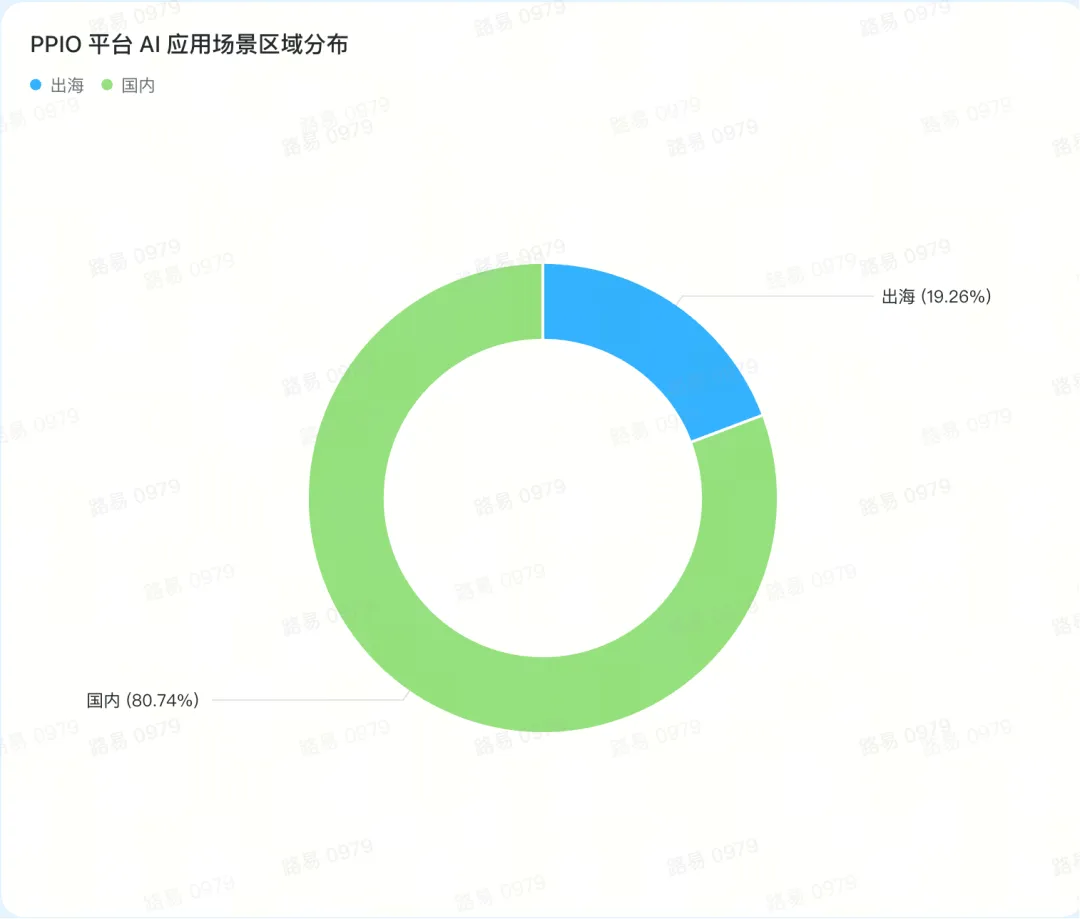

出海需求高涨,约 20% 用户的 AI 应用场景面向海外

全球 AI 市场空间是国内的几倍,海外用户对 AIGC 产品的创造性和付费意愿可能比国内更强,如东南亚、非洲等地区市场潜力大。国内 AI 领域的创业团队和独立开发者更灵活、更迅速地在全球市场崛起。

在 PPIO 平台,有不少客户“立足国内,服务全球”,有大约 20% 的 AI 应用场景面向海外。

趋势十:

2025,智能体大爆发

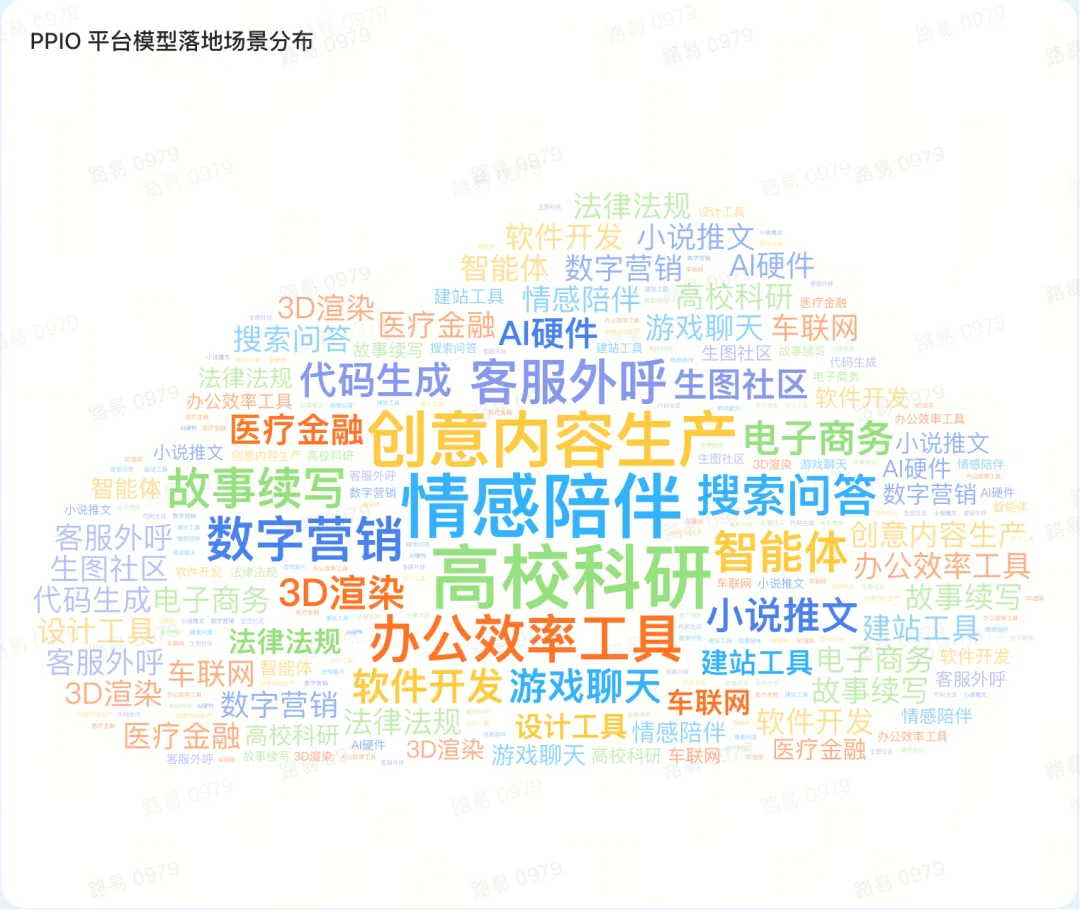

大模型的业务场景分布在各行各业。可以说,从国有银行到街边奶茶店,从手术台到炼钢炉,大模型已没有行业死角。

在 PPIO 平台。情感陪伴类应用、创意内容生产类工具、办公效率类工具以及高校科研项目是对 AI 最大需求方。

同时,2025 年上半年智能体应用也在快速爆发,Manus、Flowith、扣子空间、Lovart、MiniMax Agent、Kimi Deep Research 等智能体获得了非常高的关注度。

针对智能体应用,PPIO 平台将在 WAIC 期间正式发布Agent Sandbox(沙箱)产品,敬请期待。

最后,如果你对本 AI 趋势报告感兴趣,可以扫码下载报告原文。