首发!PPIO 上线 DeepSeek-Prover-V2-671B,无门槛教程来了

刚刚,“源神” DeepSeek 又开源了!

DeepSeek 在 Hugging Face 开源了一个名为 DeepSeek-Prover-V2-671B 的新模型,是一款基于 671B 参数的 MoE 大模型,结合 FP8 量化、高维嵌入、长上下文与专家选择优化,专为数理逻辑与高复杂度任务设计。

🔥 作为一站式 AIGC 云服务平台,PPIO派欧云在第一时间上线了 DeepSeek-Prover-V2-671B!

PPIO 平台 DeepSeek-Prover-V2-671B 模型的基本信息:

- 价格:输入 - ¥4/百万 tokens,输出 - ¥16/百万 tokens

- 上下文窗口:160k,最大输出 token 数:160k

体验入口:

https://ppinfra.com/llm/deepseek-deepseek-prover-v2-671b

本文将从两部分介绍:

- DeepSeek-Prover-V2-671B 模型的基本技术信息

- 如何在 PPIO 使用 DeepSeek-Prover-V2-671B ?

# 01

DeepSeek-Prover-V2-671B 模型的基本信息

1. 超大规模:671B参数的稀疏MoE模型

- 使用稀疏专家结构(Mixture-of-Experts),token 被动态路由到多个子模型(专家),总参数约 671B(billion),每次推理时只激活 8 个专家,可提升特定任务表现,如数学和逻辑推理,推理成本更低。

- 专家中间层维度为 2048

- 使用了 top-k 路由机制 + sigmoid 评分函数

- 所有 token 共享 1 个专家(

n_shared_experts=1),增强鲁棒性 - 路由概率标准化、topk 分组策略进一步提升分配效率和性能

2. 深层架构 + 高维特征建模

- 61 层 Transformer block

- 每层 128 个 attention heads

- 每个 token 的表示维度高达 7168

- 高维表达力 + 深度架构,使模型更擅长处理复杂推理任务

3. 超长上下文:支持长达 163,840 个 token

- 使用先进的 YaRN RoPE位置编码机制

- 支持最大 163,840 token(适合处理超长文本、证明链、多轮推理)

- 动态 rope 缩放(beta_fast, beta_slow, factor 等参数)提高长文本推理稳定性

4. 高效推理优化:FP8量化 + LoRA适配

- 使用 FP8 (e4m3 格式) 动态量化进行高效推理

- 支持块级量化(128x128),降低显存使用

- 同时集成了 LoRA(低秩适配)机制:

q_lora_rank: 1536;kv_lora_rank: 512

为多任务或垂类微调提供轻量化调参方式

5. 兼容 HuggingFace Transformers

- 完整集成 HuggingFace 自动化接口(

AutoModel,AutoModelForCausalLM等) - 支持 cache、可插拔的 tokenizer、支持 inference、微调与服务化部署

6. 应用场景方向

- 自动数学证明

- 代码生成与修复

- 多步骤复杂逻辑推理任务

- 长文档分析(论文、合约)

- 学术/研究场景下的 AI 助手

# 02

如何在 PPIO 使用 DeepSeek-Prover-V2-671B?

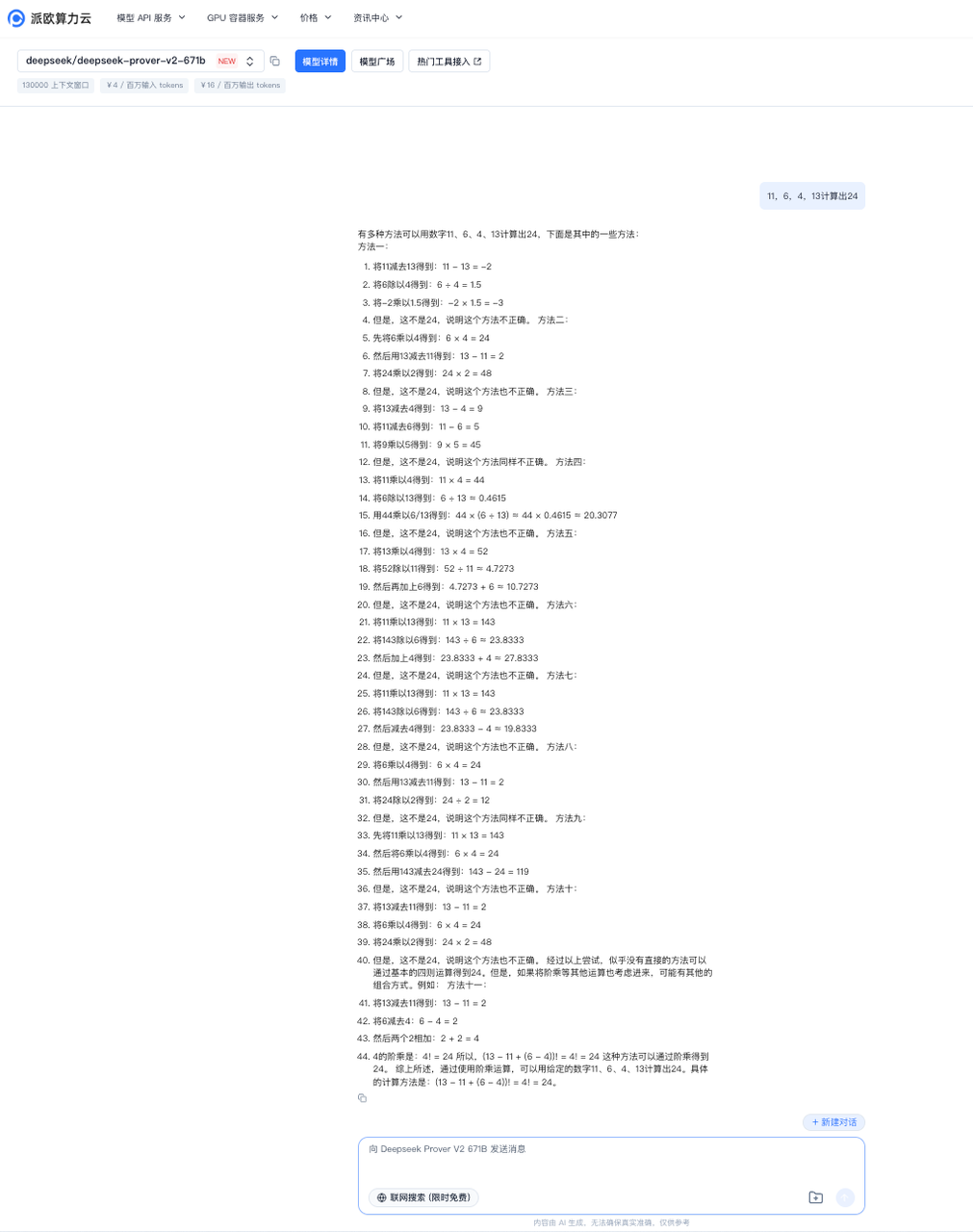

1. 直接在模型广场体验(无须代码)

到 PPIO 官网注册后,找到模型广场直接进行体验,支持联网搜索与上传文档。

快速入口:

https://ppinfra.com/llm/deepseek-deepseek-prover-v2-671b

2. 在第三方平台上集成 DeepSeek-Prover-V2-671B

除了在自己开发的应用程序中集成 API,你也可以直接通过第三方应用来调用 PPIO API 的能力。目前 PPIO 支持在 20+ 主流平台中调用平台模型,具体包括:

- 通用对话客户端:Chatbox、LobeChat、Nextchat、ChatHub、CherryStudio

- 通用AI助手:OpenManus、UI-TARS

- 代码开发工具:Cursor、CLINE

- 开发/ API 平台:Dify、OneAPI、RAGFlow、FastGPT

- 生产力套件集成:Word、WPS Office AI,这些是办公软件集成AI功能。

- 智能翻译工具:沉浸式翻译、欧路词典、流畅阅读、沉浸式导读。

- 知识管理工具:思源笔记、Obsidian、AnythingLLM

详细教程:

https://ppinfra.com/docs/third-party/overview

3. 在自己开发的应用程序中集成 API (针对开发人员)

通过 PPIO 的 API 接口,将 DeepSeek-Prover-V2-671B 无缝集成到你的应用程序、工作流或聊天机器人。PPIO 提供多语言 SDK(cURL、Python、JavaScript 等)。

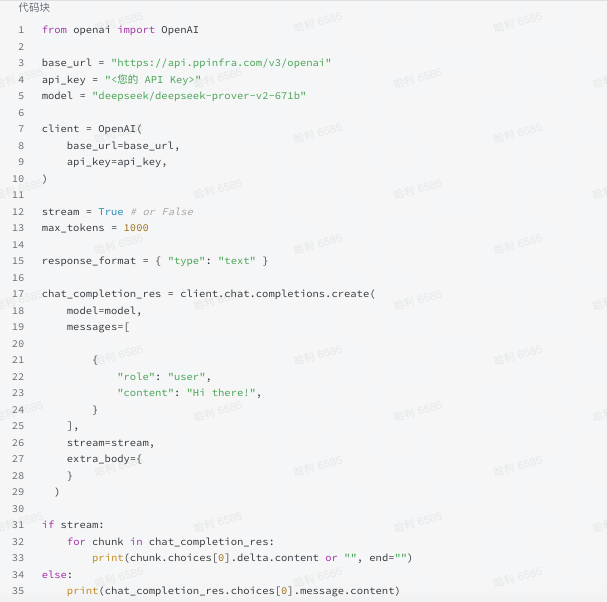

如果是单轮或多轮对话应用、轻量集成、普通 chatbot 项目,可直接调用 API。以 Python 为例:

主要特点:

- OpenAI 兼容接口:使用

/v3/openai统一接口,兼容openai.ChatCompletion调用方式。 - 无需部署模型:无需管理模型权重或基础设施,后端完全托管。

- 输出方式:支持流式和一次性返回

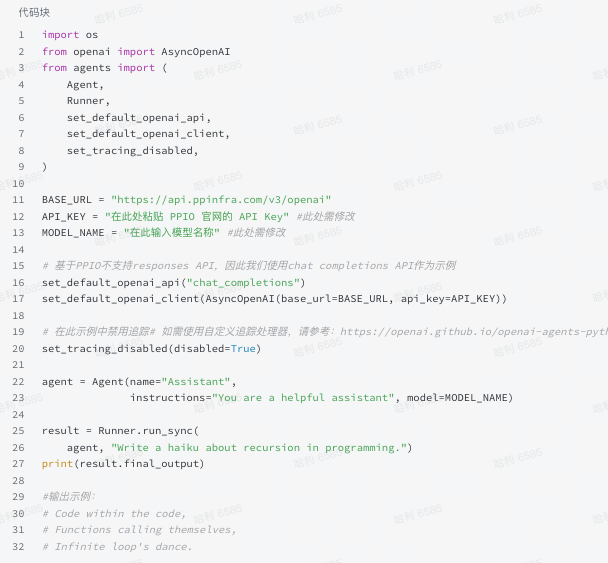

如果是构建复杂的多代理工作流,比如使用 OpenAI Agents SDK,可以按照以下方式操作:

1) 前置条件:获取 API Base URL 以及 PPIO LLM API key;

2) 设置 Python 环境并安装 Agents SDK,输入以下代码即可完成操作:

以输出功能为例。运行前,请确保已设置 PPIO API KEY 和 DeepSeek-Prover-V2-671B 环境变量。

🔥 PPIO 福利活动火热进行中

PPIO派欧云致力于为企业及开发者提供高性能的 API 服务,目前已上线 DeepSeek R1/V3、Llama、GLM、Qwen 等系列模型,仅需一行代码即可调用。并且,PPIO 通过 2024 年的实践,已经实现大模型推理的 10 倍 + 降本,实现推理效率与资源使用的动态平衡。

1. 如果你是新用户,现在注册 PPIO 立即获得 5 元免费额度(约为 500 万 DeepSeek V3 tokens);

2. 如果你有邀请码,通过邀请码注册可立即获得 15 元无门槛代金券;如果你没有邀请码,可点击下方链接(或者点击文末「阅读原文」),

立即领取:

https://ppinfra.com/user/register?invited_by=N7EUVY

3. 分享你的专属邀请码,每成功邀请 1 位好友注册并完成实名认证,即可获得 30 元无门槛代金券。

代金券适用于包括 DeepSeek-Prover-V2-671B 在内的 PPIO 所有大语言模型 API 服务!