PPIO CEO姚欣:大模型竞赛带动算力需求猛增,算力行业迎来蓬勃发展期

PPIO受邀参与·2023甲子引力X智能新世代”峰会,并入选“星辰20:2023中国AI算力层创新企业”

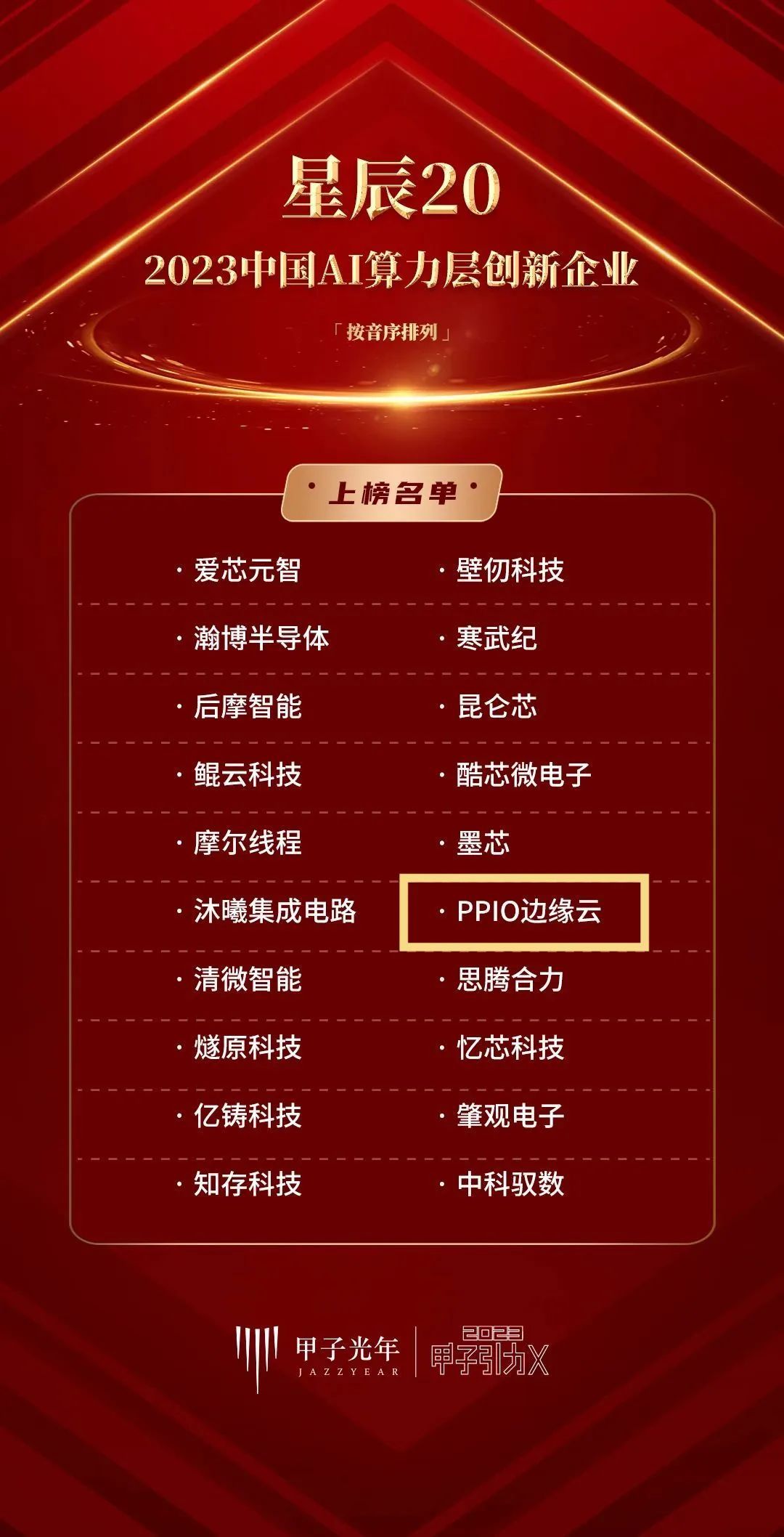

PPIO入选星辰20:2023中国AI算力层创新企业

4月25日,由中国科技产业智库甲子光年主办、上海市信息服务业行业协会支持的“共赴山海·2023甲子引力X智能新世代”峰会在上海召开,颁布了“星辰20创新企业”榜单,表彰AIGC时代背景下创新企业的杰出贡献者。

PPIO边缘云作为国内领先的独立边缘云服务提供商,基于PPIO高质量音视频边缘服务与优化解决方案,凭借其技术创新性、广泛的行业价值和社会价值等优势,入选了“星辰20:2023中国AI算力层创新企业”。

姚欣的精彩观点

峰会现场,PPIO边缘云联合创始人姚欣受邀出席了《行稳致远:大模型、大算力与可持续发展——新智能时代的基础设施》主题圆桌中,与达观数据董事长兼CEO陈运文、亚马逊云科技初创生态架构师团队技术负责人孔雷、上海交通大学计算机科学与工程系教授&开源GPGPU平台“青花瓷”发起人梁晓峣、华映资本管理合伙人章高男、亿铸科技高级副总裁徐芳共同探讨了大模型实现路径的多种可能性。

参数量大不意味着AI更智能

当下,谈及人工智能,有一个现象是所有人都无法忽视的——由OpenAI的ChatGPT和GPT-4带来的AI冲击,掀起了巨大风浪,国内的科技巨头、创业公司与高校研究院们展开了一轮关于“大模型”(Foundation Model)的军备竞赛,投入大量人力和资金,梦回“2000年左右的互联网创业潮”。

“大模型”对比“小模型”,是一种“基于大量数据训练的、拥有巨量参数的模型”,OpenAI首席执行官Sam Altman与李开复则将其定义为“一种新技术平台”。

在姚欣看来,正如此前我们去讨论“大数据时代”,如今我们进入到“大模型时代”。人工智能三大核心要素是数据、算力和算法,大数据为AI大模型提供了数据基础,但大模型之争不应把追求参数量之大作为一种简单的目标或口号,我们要清晰的认识到:参数量大并不意味着AI更智能。因为在模型的学习曲线中,除了数据和参数,还包括数据质量、数据整理、算法优化和工程化,最终综合训练出模型对多种模态信息的高效理解能力、跨模态的感知能力以及跨差异化任务的迁移与执行能力。

因此,在模型训练过程中,需要先基于更小但更优质的数据进行训练,得到一个更为有效的模型基础,进而再进行放大和延伸。

算力更大的挑战来自推理侧

OpenAI首席执行官Sam Altman曾表示:“新版摩尔定律很快就要来了,宇宙中的智能每18个月翻一倍。”

暂且抛开对这句论断的争议,在大模型时代,我们已经看到了模型训练和应用,对算力的巨大需求和成本消耗,以至于ChatGPT也频频限流。随着“新摩尔定律”的到来,这一算力消耗势必会呈现出指数级增长。据推测,如果让ChatGPT承担谷歌搜索的全部访问量,总共需要410万张英伟达A100 GPU。

在AI技术中,算力是算法和数据的基础设施,影响着AI的发展。那么,何种算力能力才能满足当前的大模型需求?在未来,怎样的算力技术更能符合和支持大模型的顺利推进?

对于这个问题,姚欣认为,当前我们谈论GPU、谈论算力,往往还是聚焦在模型训练侧,但更大的挑战来自推理侧。OpenAI曾讲到,未来的算力推演中,训练侧仅占5%的算力,而95%是在推理侧。也许在训练侧,我们对英伟达A100一卡难求,但在推理侧,我们的芯片选择会更多。随着AI应用普及,推理侧将直接服务用户和应用,面对的是海量流量的冲击,所需要的算力规模将千万倍增长,如何降低算力成本将成为关键。

未来,各类大模型AI上线应用后,将会引发算力大爆发,进而带来整个从云边端、芯片底层到云算力平台的爆发。届时,算力之争将会是更为繁荣的场景。

呼吁数据开源标准化,推动AI共同发展

ChatGPT的诞生被视为“AI界的iPhone时刻”,是计算领域有史以来最伟大的技术之一。然而,OpenAI对于软件是开源还是封闭的态度,则像是历史上Linux和Windows、Android和iOS之间上演的“IT战争”的重演。

3月1日,OpenAI宣布正式开放ChatGPT API,开发者可通过API将ChatGPT和Whisper模型集成到他们的应用程序和产品中。这意味着,企业或个人开发者无需自研,可直接使用ChatGPT模型进行二次应用和开发。但GPT-4却采用闭源模式发布,OpenAI甚至表示“开源并不明智,我们之前错了”。

对于科技及产业发展,开源和闭源哪个是更好的选择?不同选择又会带来何种影响?

在姚欣看来,过往的“IT战争”正在AI领域上演,微软仿佛回到了20年前,又选择了闭源。在产业创新阶段,姚欣认为闭源是可以理解的,比如iPhone在闭源的状态下,才能够更为专注地进行垂直整合、体验提升,以及打通商业模式。

当前,AI也处于闭源先行的过程,但是我们已经意识到,一家公司不可能穷尽所有的细分领域,一个大模型也不可能服务于所有通用的场景。因此,我认为中国作为一个AI的追赶者,我们必须拥抱开源,特别是数据开源标准化,将大模型打造成新时代的水电煤这样的基础设施,推动国内AI产业的共同发展。

PPIO构建分布式算力网络加速AI应用场景落地

面向数字经济时代,以通信技术和计算能力为基础的“新生产力”——算力的重要性逐渐凸显。作为中国领先的独立边缘云服务提供商,PPIO秉承“汇聚全球计算资源”的使命,正以共享模式整合碎片化算力资源,构建分布式的算力网络云服务,这正是PPIO的优势所在。PPIO致力于将云的能力、网的能力、算的能力进行有机结合,基于边缘云原生技术,实现与中心云协同融合发展,让边缘云算力服务如同“水电气煤”一样触手可达,从一定程度上缓解AI产业对算力的迫切需求。

未来算力网络的高速增长使其在架构、带宽、时延等方面提出更高的需求,PPIO通过自主研发边缘云原生系统,克服碎片、非标、异构的边缘侧挑战,不断提高算力能力,进一步降低底层技术成本,加速AI应用场景落地。