PPIO首发上线DeepSeek-V3.1-Terminus

刚刚,PPIO 首发上线 DeepSeek-V3.1 的更新版本 DeepSeek-V3.1-Terminus!该版本的模型输出效果相比前一版本更加稳定。

此次更新在保持模型原有能力的基础上,针对用户反馈的问题进行了改进,包括:

- 语言一致性:缓解了中英文混杂、偶发异常字符等情况;

- Agent 能力:进一步优化了 Code Agent 与 Search Agent 的表现。

“Terminus”源自拉丁语,意为“终点、完结”之意,或许代表了 DeepSeek V3 这一大版本的最终更新,后续的更新或将开启新版本。

快速入口:

https://ppio.com/llm/deepseek-deepseek-v3.1-terminus

开发者文档:

https://ppio.com/docs/model/overview

DeepSeek-V3.1-Terminus

表现如何?

根据官方文档,此前的 deepSeek-chat 和 deepseek-reasoner 都已经升级为 DeepSeek-V3.1-Terminus。

deepSeek chat 对应 DeepSeek-V3.1-Terminus 的非思考模式,deepseek-reasoner 对应 DeepSeek-V3.1-Terminus 的思考模式。

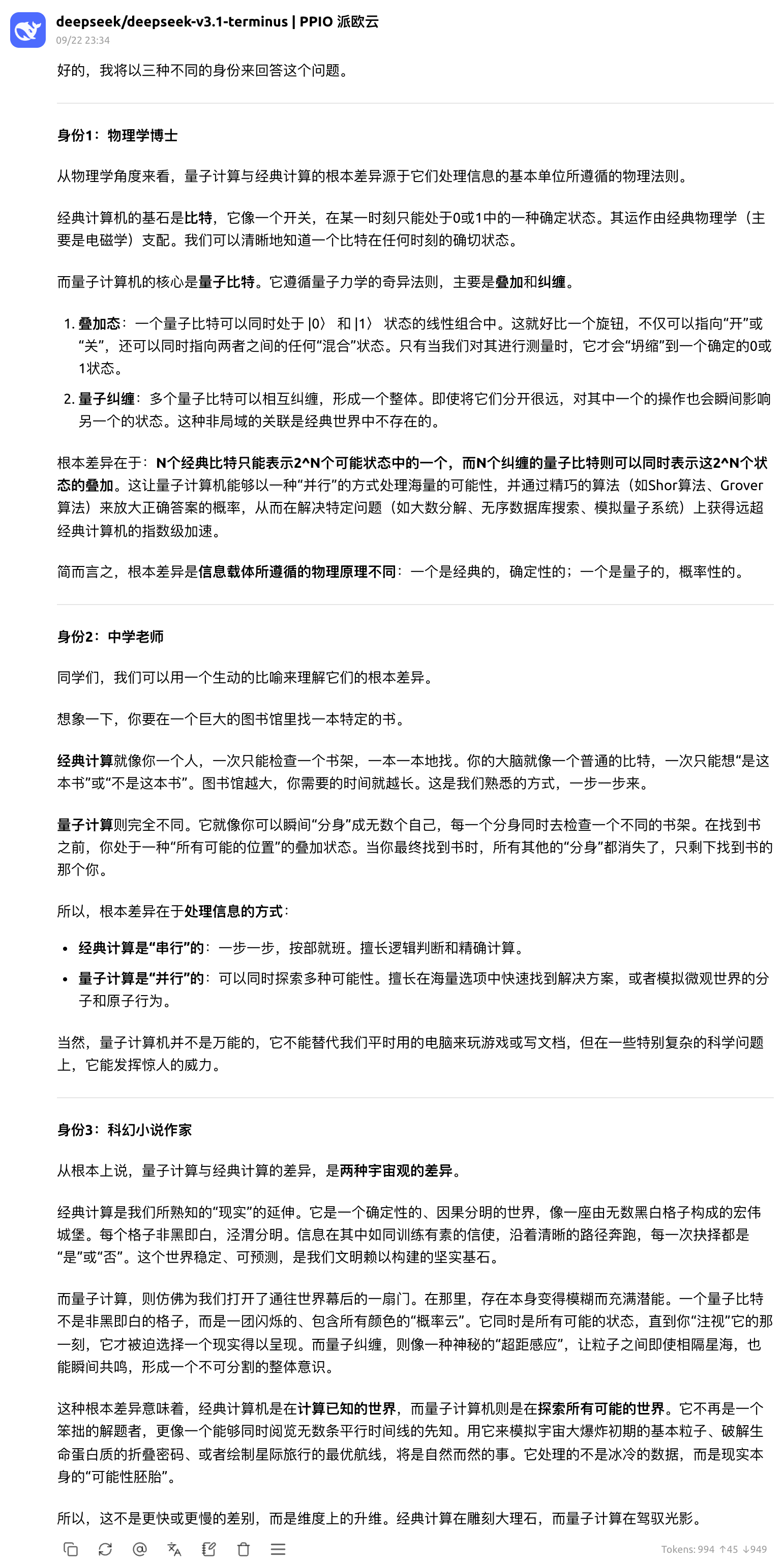

我们将 PPIO DeepSeek-V3.1-Terminus 的模型 API 接入 Cherry Studio 进行体验。

(1)非思考模式提示词:

请用三种不同的身份回答同一个问题:

问题:量子计算与经典计算的根本差异是什么?

- 身份1:物理学博士

- 身份2:中学老师

- 身份3:科幻小说作家

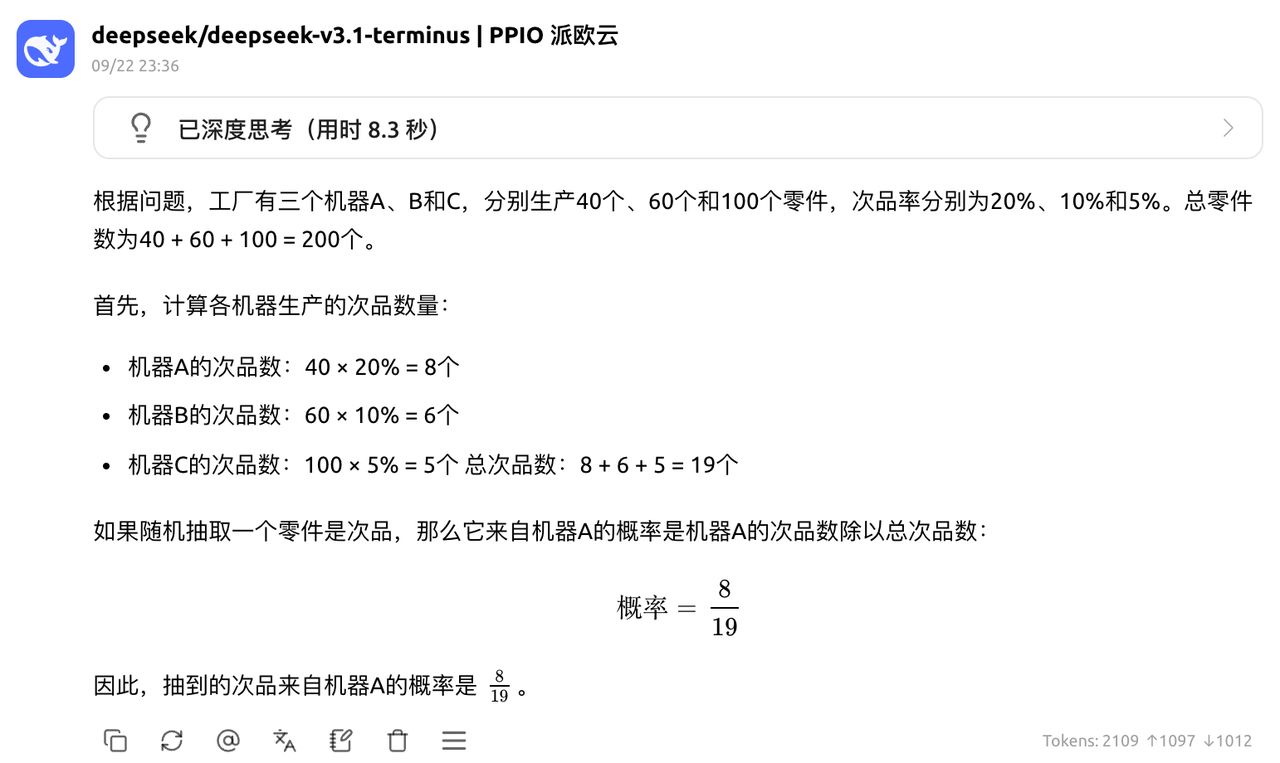

(2)思考模式提示词:

某工厂有三个机器:A、B、C。

- A 生产 40 个零件,每个零件有 20% 概率次品。

- B 生产 60 个零件,每个零件有 10% 概率次品。

- C 生产 100 个零件,每个零件有 5% 概率次品。

如果我从总产出里随机抽一个零件,结果是次品,

那么它来自机器 A 的概率是多少?

你可以到 PPIO 官网在线体验 DeepSeek-V3.1-Terminus ,或者将模型 API 接入 Cherry Studio、ChatBox 或者你自己的 AI 项目中。

查看详细接入教程:

https://ppio.com/docs/model/overview

DeepSeek-V3.1-Terminus 进一步优化了 Code Agent 与 Search Agent 的表现。