PPIO上线MiniMax-M1-80k:全球首个开源大规模混合架构推理模型

今天,PPIO 首发上线 MiniMax-M1,这是全球首个开源大规模混合架构的推理模型。

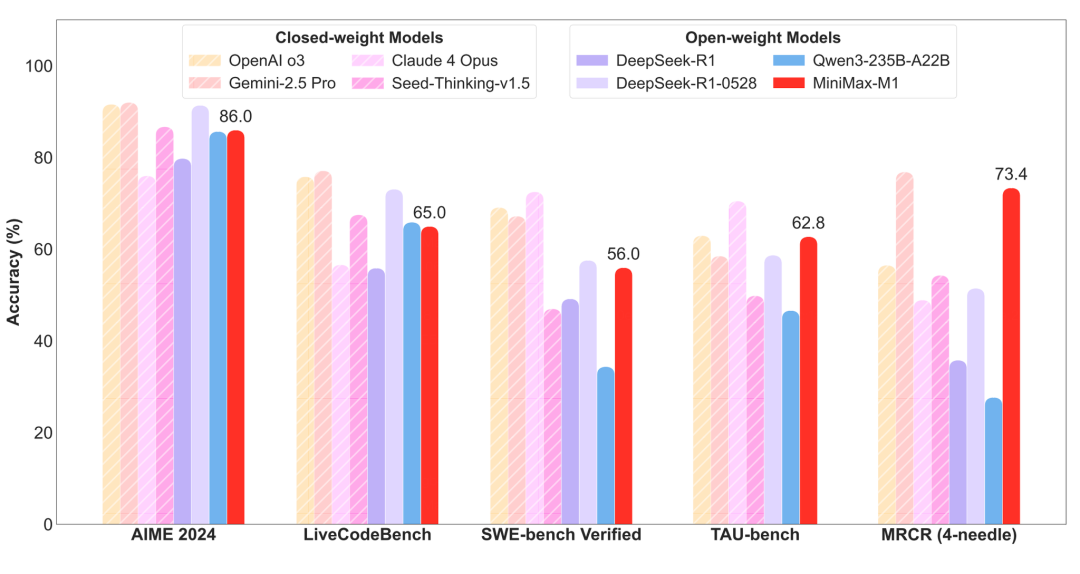

MiniMax-M1 采用混合专家 (MoE) 架构,并结合闪电注意力机制。该模型总共包含 4560 亿个参数,每个令牌激活了 459 亿个参数。M1 模型原生支持 100 万个令牌的上下文长度,是 DeepSeek R1 上下文大小的 8 倍。同时MiniMax-M1 结合 CISPO 算法与混合注意力设计的高效强化学习训练,在长输入推理与真实软件工程场景中实现了业界领先的性能。

因为相对高效的训练和推理算力使用,该模型可以以业内最低的价格提供 API 服务。PPIO 平台的 MiniMax M1-80k 价格为:输入¥4/百万 tokens,输出 ¥16/百万 tokens,上下文窗口为128k。

快速体验入口:

https://ppio.cn/llm/minimaxai-minimax-m1-80k

第三方平台集成 API:

https://ppio.cn/docs/third-party/overview

API 开发者文档:

https://ppio.cn/docs/model/llm

# 01

在 PPIO 在线体验 MiniMax M1

M1 在面向生产力的复杂场景中能力是开源模型中的最好一档,超过国内的闭源模型,接近海外的最领先模型,同时又有业内最高的性价比。

在 PPIO 官网,输入提示词:

Create an HTML page with a canvas-based animated particle background. The particles should move smoothly and connect when close. Add a central heading text over the canvas。

生成代码的网页效果如下:

M1 有一个显著的优势是支持目前业内最高的 100 万上下文的输入,跟闭源模型里面的 Google Gemini 2.5 Pro 一样,是 DeepSeek R1 的 8 倍,以及业内最长的 8 万tokens 的推理输出。

于是,我们进行了一番测试,直接让 M1 翻译了一份中文版的 M1 的技术报告,点击查看:

https://ppio-cloud.feishu.cn/wiki/SeBiwQQIWiNMGOkrNz7c8I1Hnzf?from=from_copylink

# 02

在第三方平台接入 PPIO API

目前 PPIO 支持在 20+ 主流平台中调用平台模型,具体包括:

- 通用对话客户端:CherryStudio、Chatbox、LobeChat、Nextchat、ChatHub、

- 通用 AI 助手:OpenManus、UI-TARS

- 代码开发工具:Cursor、CLINE

- 开发/ API 平台:Dify、OneAPI、RAGFlow、FastGPT

- 生产力套件集成:Word、WPS Office AI,这些是办公软件集成AI功能。

- 智能翻译工具:沉浸式翻译、欧路词典、流畅阅读、沉浸式导读。

- 知识管理工具:思源笔记、Obsidian、AnythingLLM

我们以 Cherry Studio 为例接入PPIO API。

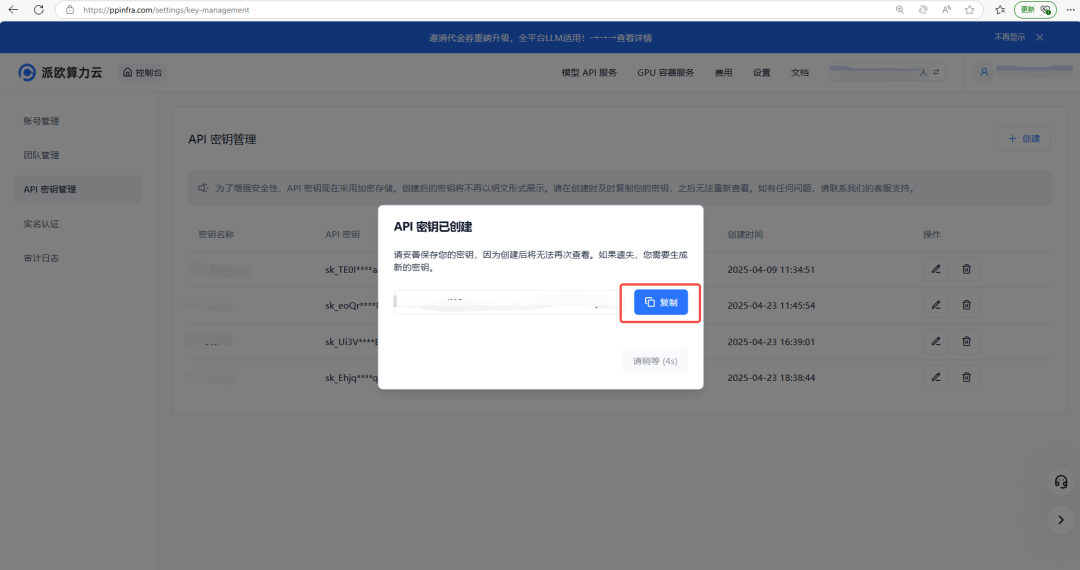

(1)获取并保存【 API key 】、【 Base URL 】和【模型名称】

注册并登录 PPIO,然后打开 API 密钥管理页面,点击【创建】按钮,输入自定义密钥名称,生成 API 密钥。

!!!注意:密钥在服务端是加密存储,请在生成时保存好密钥(比如记录在备忘录里);若遗失密钥,可以在控制台上删除并创建一个新的密钥。

然后到模型广场获取模型名和 Base URL,固定地址为:

https://api.ppinfra.com/v3/openai

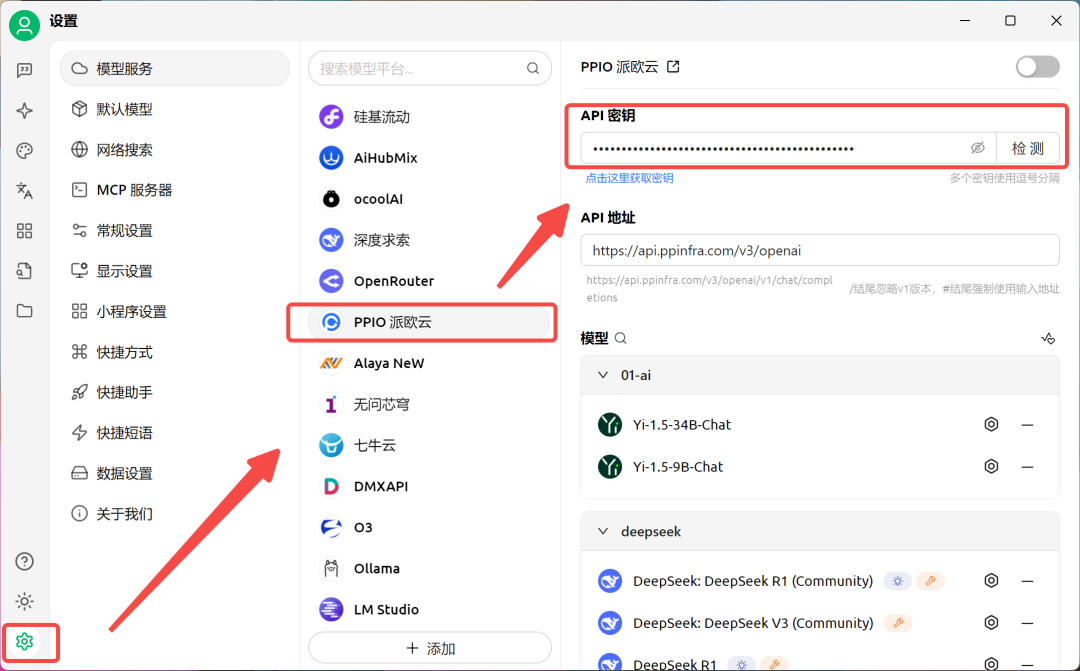

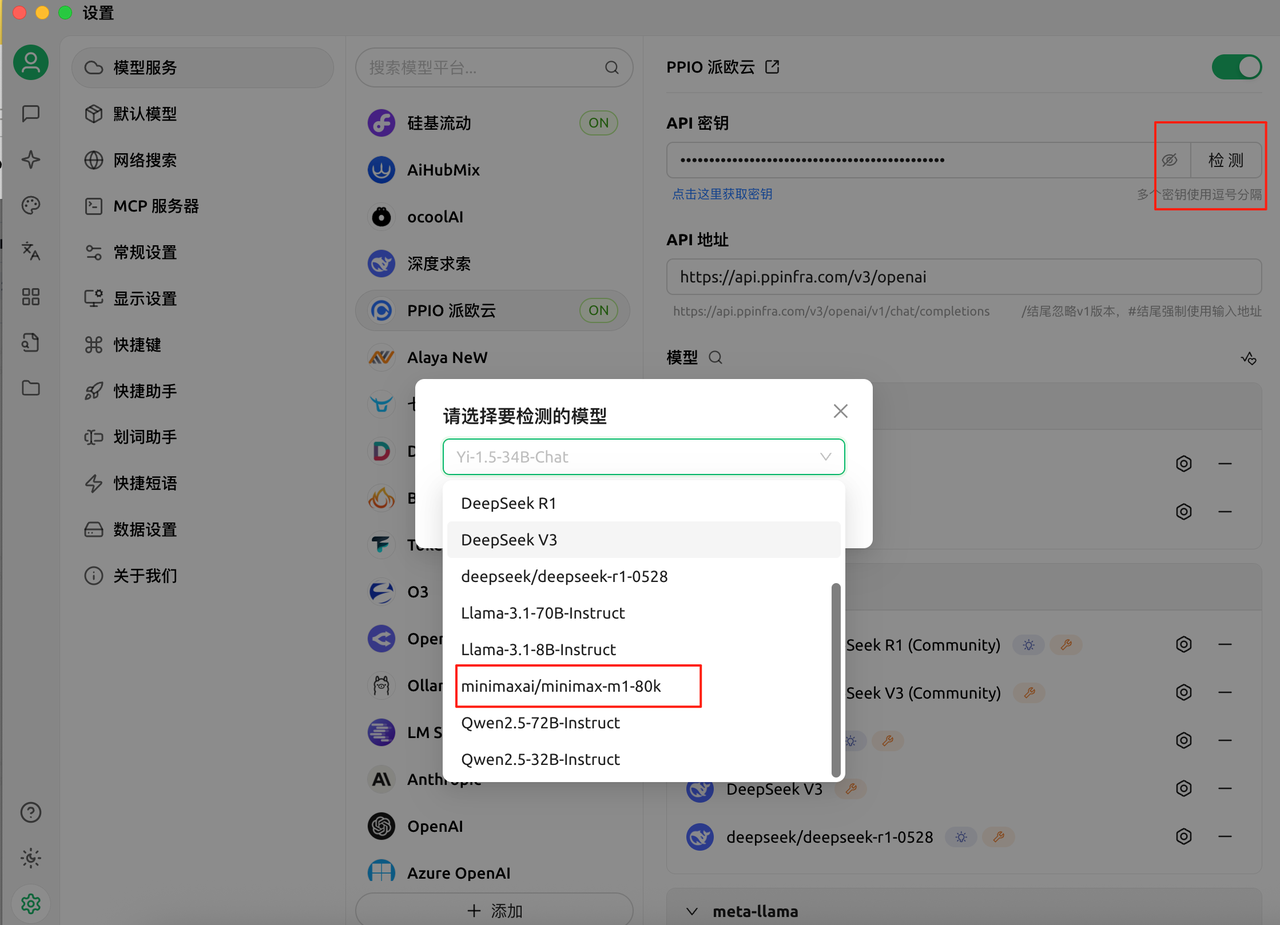

(2)在 Cherry Studio 中配置 API 密钥

下载并安装 Cherry Studio,官网地址为:

https://cherry-ai.com/download

打开 Cherry Studio,点击设置,选择【PPIO派欧云】,输入官网生成的 API 密钥。

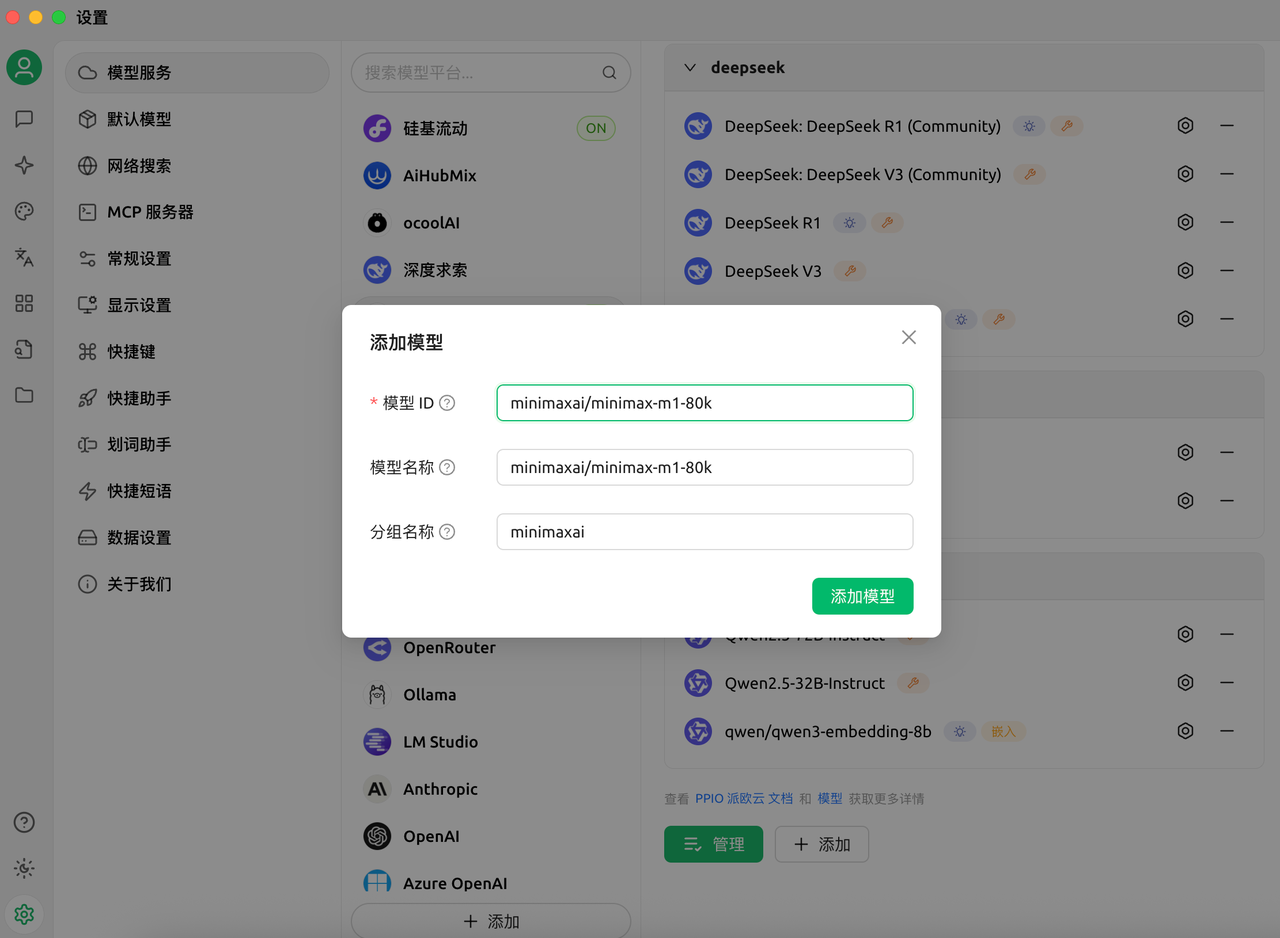

点击【添加】,填入所需模型名称

minimaxai/minimax-m1-80k。

添加后点击【检测】,选择 MiniMax-M1-80k,会显示检测通过。

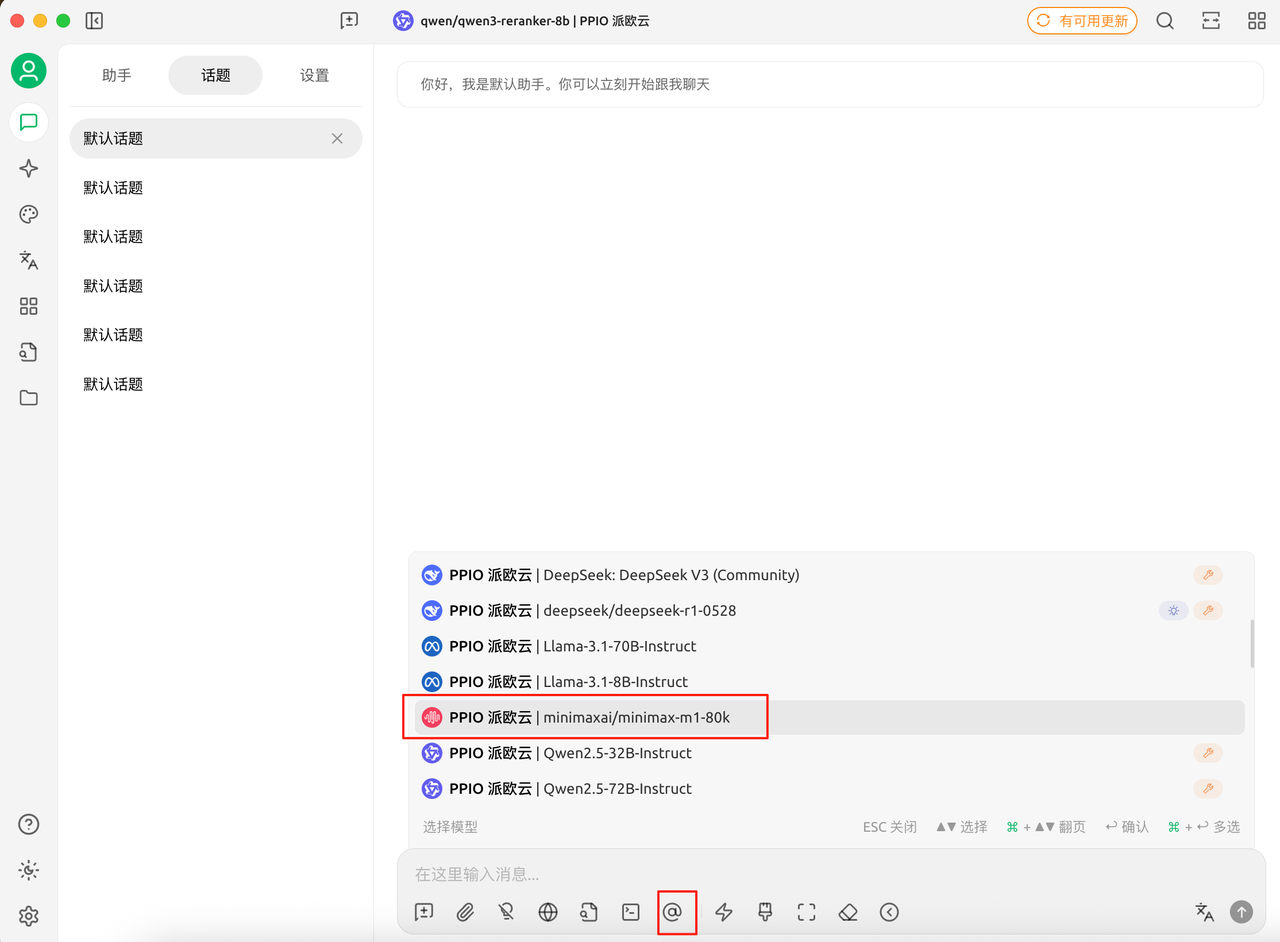

回到对话窗口,点击@,选择 MiniMax M1 模型后即可使用。

# 03

API 开发者文档

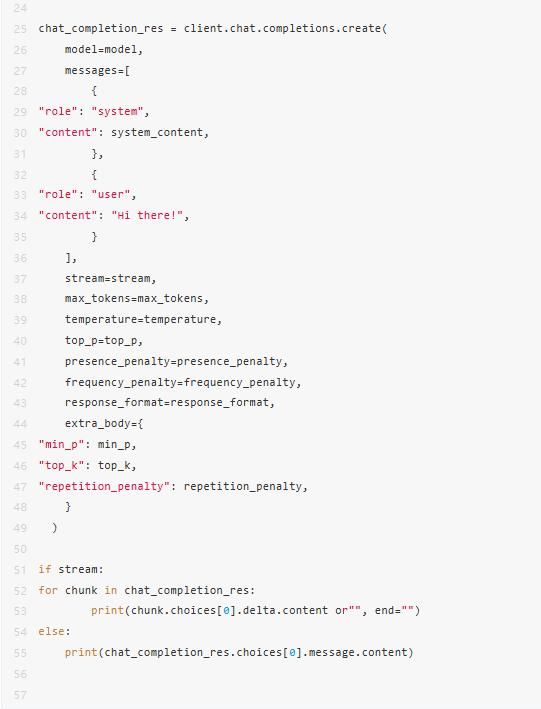

通过 PPIO 的 API 接口,可以将 LLM API 无缝集成到你的应用程序、工作流或聊天机器人。PPIO 提供多语言 SDK(cURL、Python、JavaScript 等)。

以 Python 为例:

主要特点:

- OpenAI 兼容接口:使用 /v3/openai 统一接口,兼容 openai.ChatCompletion 调用方式。

- 无需部署模型:无需管理模型权重或基础设施,后端完全托管。

- 输出方式:支持流式和一次性返回

API 开发者文档:

https://ppio.cn/docs/model/llm