PPIO上线高性能版Deepseek R1/V3 Turbo!吞吐性能3倍提升,限时8折优惠!

作为国内最早上线 DeepSeek 全模型的 API 供应商之一,PPIO派欧云致力于为AI开发者和企业提供低成本、稳定可靠、接入简单的大模型 API 和 GPU 算力服务。

目前我们又推出了高性能版 Deepseek-r1-turbo,Deepseek-v3-turbo 模型,重新定义推理性能边界!

Ⅰ. 模型性能解读

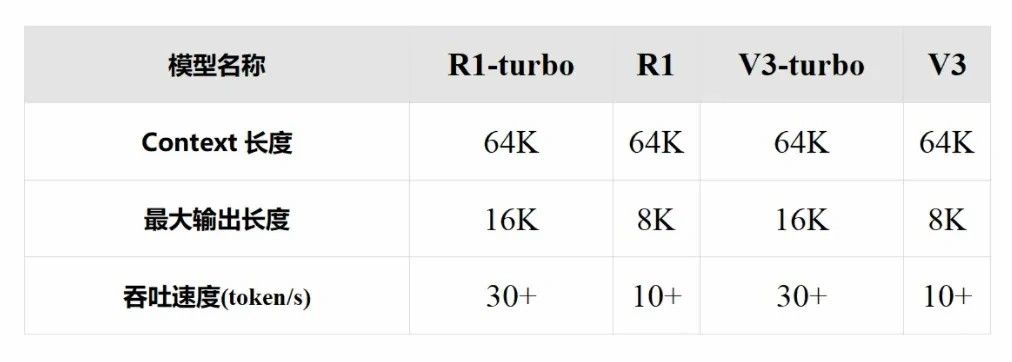

- Turbo 系列模型依旧保持全参数满血版,无性能损失。

- 吞吐速度达到 30+TPS,相较于 2 月版本增长 3 倍,满足高并发场景需求。Max output 由 8k 增加至 16k,支持更长文本生成。

- 依旧保持 99.9% 高服务可用性,为企业级用户保驾护航。

Ⅱ. AI 低成本赋能

PPIO派欧云与 Deepseek 官方模型保持基础定价一致,但为助力 AI 技术普惠化,现对 Turbo 系列模型开展限时优惠活动。

当前 Turbo 系列模型输入/输出单价直降 20%,让广大开发者以更低门槛体验行业前沿的AI能力。

👉 前往体验:

https://ppinfra.com/model-api/product/llm-api

Ⅲ. 开发者生态

PPIO派欧云致力于大幅降低 AI 基础设施的使用成本和门槛,将前沿技术的力量带给每一位创新者。

『初创企业扶持计划』

立即申请我们的【初创企业扶持计划】,最高可享 ¥10 万额度补贴,还可申请 DeepSeek 专属折扣福利。这不是简单的扶持,而是给创新者的火箭推进器!

『热门三方平台集成』

PPIO派欧云支持在 20+ 主流平台中调用高性能版 Turbo 模型。

👉 查看使用教程:

https://ppinfra.com/docs/model-api/third-party/overview

目前已接入的第三方软件:

通用对话客户端:Chatbox、LobeChat、Nextchat、ChatHub、CherryStudio

代码开发工具:Cursor、CLINE

开发/ API 平台:Dify、OneAPI、RAGFlow、FastGPT

生产力套件集成:Word、WPS Office AI,这些是办公软件集成AI功能。

智能翻译工具:沉浸式翻译、欧路词典、流畅阅读、沉浸式导读。

知识管理工具:思源笔记、Obsidian、AnythingLLM