PPIO派欧云入选甲子光年智库《中国AI算力行业发展报告》重点厂商案例

近日,由甲子光年智库发布的《中国 AI 算力行业发展报告》重磅亮相,迅速引发业界高度关注。这份报告聚焦 AI 产业的核心引擎-算力,以其独特的视角、深入的行业洞察力,为中国 AI 算力行业描绘了一幅全景式发展蓝图。

报告不仅梳理了行业发展的脉络,还全面剖析了当前算力资源供需失衡的现实挑战及未来发展趋势,为行业指明了突破方向。

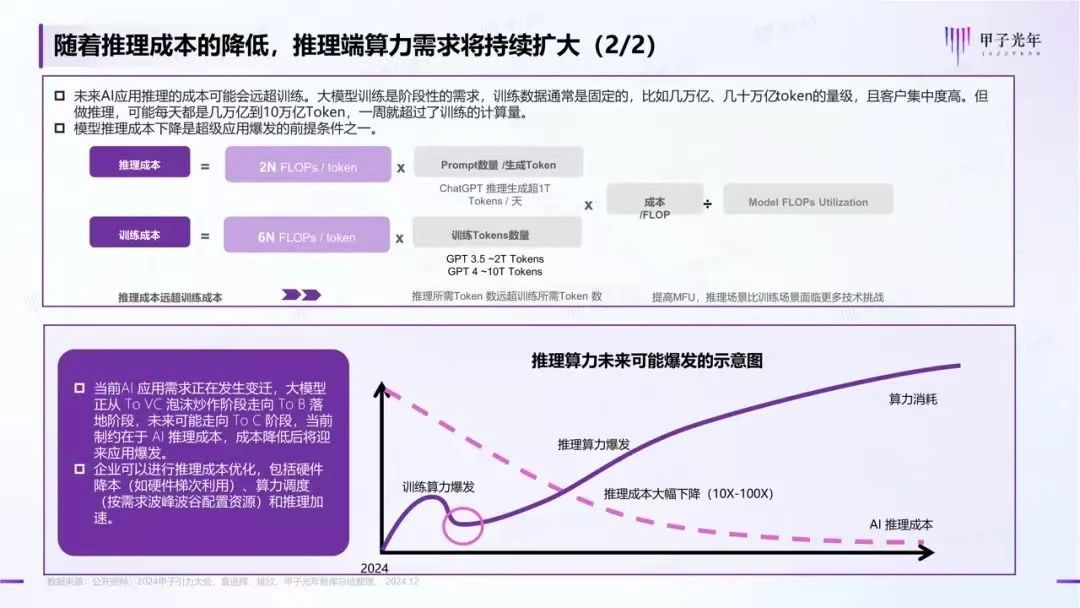

报告参考了 PPIO派欧云在 2023 年提出的趋势洞察:预计 2025 年之前,智算主要集中在训练侧,支持高参数大模型的开发与迭代。

但随着技术的进步和推理成本的持续下降,大模型创新应用的爆发将推动智算需求逐步向推理侧转移。

2024 中国 AI 算力领域服务商图谱

在此次报告发布的《2024 中国 AI 算力领域服务商图谱》中,PPIO派欧云作为行业领先的分布式 AI 智算云服务商,成功入选“智算服务平台”和“云服务”两大领域,充分展现了其在技术创新和服务能力方面的卓越表现。

PPIO派欧云凭借前沿的分布式计算、云原生、Serverless 技术,以及算法、系统、硬件协同优化的 AI 推理加速技术,持续为客户提供高性价比、稳定可靠、高效弹性的 AI 智算及云服务,解决了行业中的关键智算痛点,获得了甲子光年的高度认可。

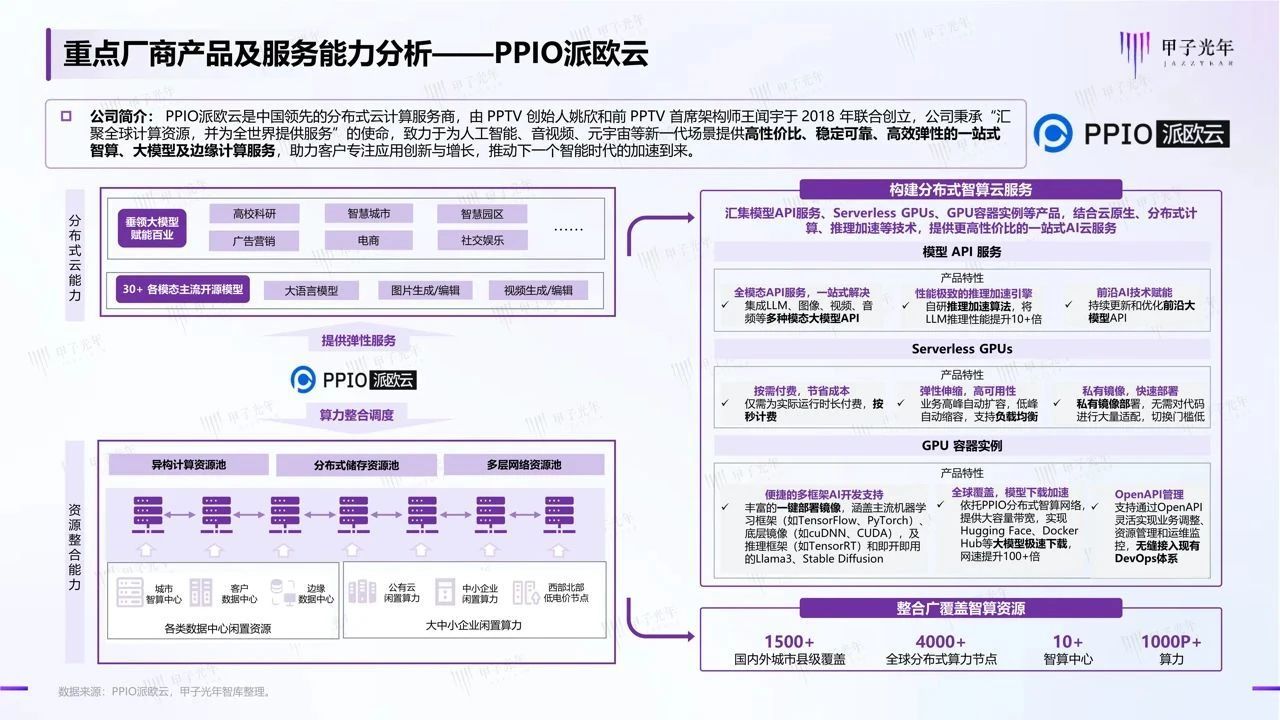

重点厂商产品及服务能力分析

在本次报告的“重点厂商产品及服务能力分析”章节中,PPIO派欧云再次成为焦点。

面对 AI 推理高昂的成本与跨时空和场景的复杂算力需求,PPIO派欧云依托全球 4000 多个分布式计算节点,构建了高效、灵活的分布式智算云服务基础设施。

通过模型 API 服务、Serverless GPUs 和 GPU 容器实例等创新产品,PPIO派欧云实现了对复杂算力资源的高效调度与灵活管理,显著提升推理效率,大幅降低 AIGC 应用运营成本。

为高校科研、智慧园区、内容营销、社交媒体、渲染设计等场景的 AI 解决方案和应用提供了强有力的模型和算力支持。

案例分析

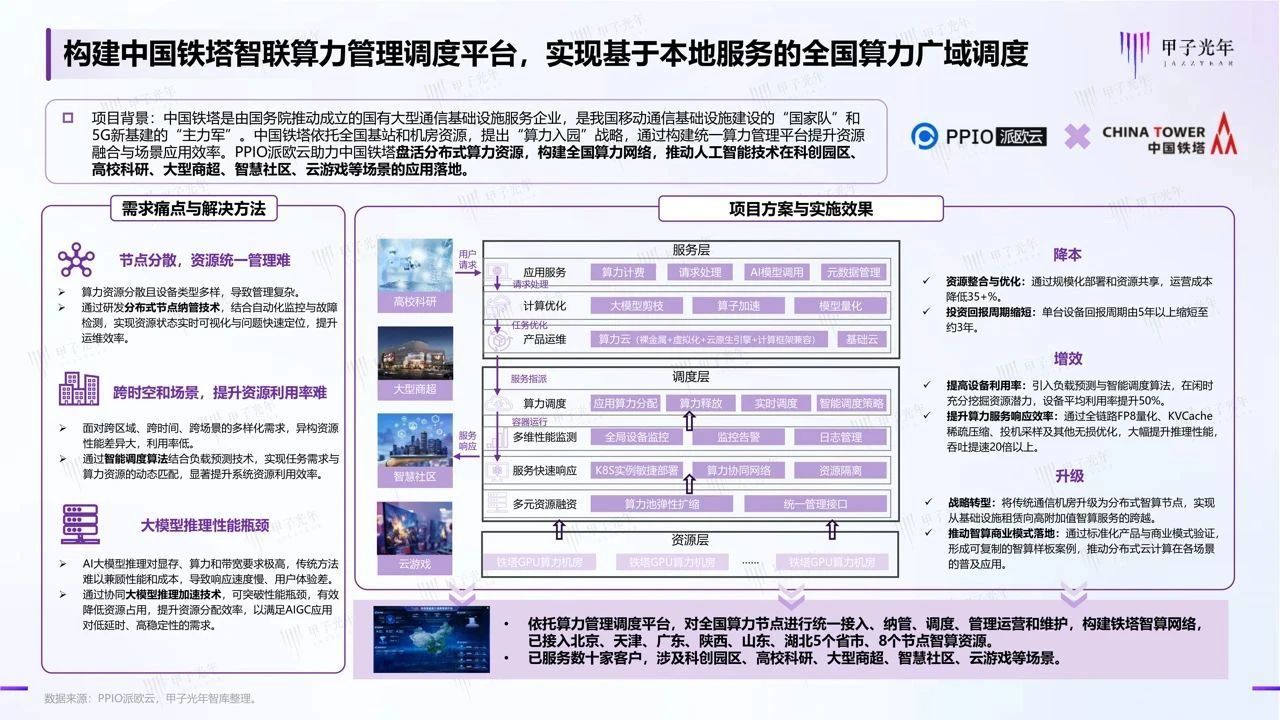

中国铁塔是由国务院推动成立的国有大型通信基础设施服务企业,是我国移动通信基础设施建设的“国家队”和 5G新基建的“主力军”。

PPIO派欧云助力中国铁塔高效调度分布式算力资源,构建覆盖全国的人工智能算力网络,实现人工智能技术在科创园区、高校科研、大型商超、智慧社区、云游戏等多元化场景的深度应用和落地。

针对当前国内算力行业的三大痛点:资源统一管理难、资源利用率低以及大模型推理性能瓶颈,PPIO派欧云通过资源层、调度层、服务层的全方位技术升级,成功实现了成本的大幅降低与性能的显著优化。

在与中国铁塔的合作中,中国铁塔智联算力管理调度平台接入北京、天津、广东、陕西、山东、湖北 5 个省市、8 个节点智算资源,助力中国铁塔构建覆盖“算力大网”,形成可复制的智算样板案例,推动分布式智算在各场景的普及应用。

本次甲子光年智库发布的《中国 AI 算力行业发展报告》不仅为 AI 算力行业提供了发展的指南针,更是增强了 PPIO派欧云继续探索分布式智算的信心。

展望未来,PPIO派欧云将继续秉承“汇聚全球计算资源,并为全世界提供服务”的使命,致力于为人工智能、音视频、元宇宙等新一代场景提供高性价比、稳定可靠、高效弹性的一站式智算、大模型及边缘计算服务,助力客户专注应用创新与增长,推动下一个智能时代的加速到来。