PPIO派欧云发布全新算力云产品,助力大模型推理千倍降本

2024年9月4日,由PPIO派欧云主办的“Power to Pioneers · 2024分布式云计算论坛暨 PPIO AI产品发布会”在上海召开。论坛聚焦于分布式云计算的技术创新、产业落地、市场趋势,及其对AIGC规模化应用的推动力。期间,PPIO推出全新的Serverless和模型API服务产品,进一步完善派欧算力云产品矩阵,标志着PPIO的分布式云服务从边缘云延伸到AI基础设施,将为AIGC创新企业和开发者带来更高性价比、弹性、易用的一站式AI基础设施产品和服务。

张江集团党委书记、董事长袁涛;华中科技大学教授、长江学者特聘教授、中国计算机学会副理事长金海教授出席本次论坛并致辞。中国信通院云大所政企数字化转型部主任徐恩庆;上海交通大学特聘教授、中国计算机学会系统软件专委副主任、开源鸿蒙技术指导委员会主席陈海波教授分别发表精彩演讲,为分布式云产业发展贡献无尽灵感。

PPIO派欧云联合创始人、董事长兼 CEO姚欣在主题演讲中指出:“遵循尺度定律的基本原理,计算能力将决定大模型创新和应用的上限。在计算资源成本高昂而需求爆增的市场格局下,分布式算力将成为引领下一轮科技革命的重要推动力,正在逐步改变全球计算资源的供给和利用方式。我们的核心理念是利用分布式云的优势,三年实现千倍降本,以算力普惠推动 AI 普惠,助力新时代的开拓者创造出全新的发展机遇。”

大幅降低AI推理成本

实现AI普惠

与模型训练相比,AI推理与产业应用关系更为密切。大模型在训练后需要通过推理应用于实际场景,这直接影响其可用性和实用性。然而,目前AI推理面临的主要问题是成本高昂,尤其是随着模型规模增大,计算需求和成本也随之增加。此外,推理效率普遍较低,加上复杂的业务场景和应用链路,进一步推高了推理成本。

为了解决AI推理的成本问题,实现大模型应用算力普惠,PPIO派欧云通过算法、系统和硬件协同创新,推出了专为AI推理场景设计的Serverless产品,提供模型部署、运行优化、弹性伸缩及API服务,帮助客户在自定义模型时获得高效的弹性效率和极致的运行成本。Serverless产品的推出使得开发者无需再管理和运维算力服务器,而是能够将精力集中于核心业务的应用逻辑开发与创新,从而帮助企业实现降本增效。

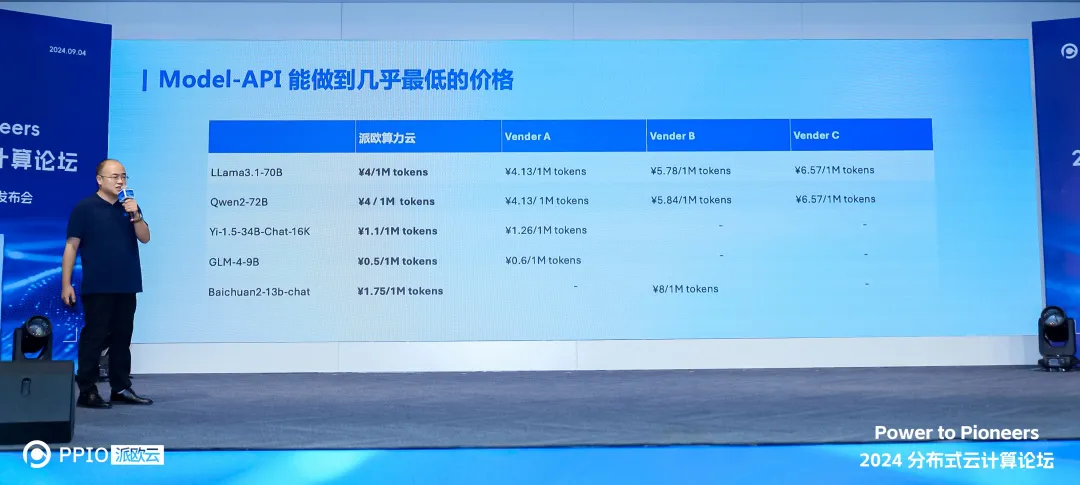

此外,PPIO派欧云还推出了全新的Model API服务产品,支持 AIGC 应用开发所需的全模态 API,开发者无需精通机器学习即可快速部署和调用大模型功能。结合PPIO强大的分布式计算能力和派欧算力云Serverless产品的弹性支持,Model API服务不仅显著提升了AI应用的开发效率,还通过按需付费模式有效降低了企业的开发和运营成本。

派欧算力云产品可广泛应用于多个场景,提供灵活且高效的解决方案。例如,在中国铁塔的智能算力调度管理项目中,为了实现在城市广泛分布的产业园、写字楼、住宅、文娱和高校等园区进行算力入园的管理服务,PPIO通过打造分布式算力网络,实现不同地区、不同时间、不同业务的弹性算力调度和大模型推理加速,为园区内的AI应用提供高性价比的智算服务,满足智能数据处理、大模型部署、AIGC生成、AI算法加速、渲染加速等一系列应用需求。

产研联动、生态协同

加速AI应用创新

会上,PPIO派欧云宣布聘请华中科技大学教授、长江学者特聘教授、中国计算机学会副理事长金海教授担任公司技术委员会主席。作为中国分布式计算领域的知名学者,金海教授将为PPIO的分布式技术发展战略和算力网络规划提供深入全面的指导,为公司未来在分布式云和AI基础设施领域的研究和创新发展奠定坚实基础。

金海教授表示:“PPIO在分布式云领域的前沿探索和创新实践,不仅展现了技术推动行业变革的深远影响,更预示着一个全新的计算时代的到来。我期待与PPIO技术团队携手,将分布式云计算的技术边界进一步拓展,推动其在更多行业中的深度应用,助力PPIO实现全球领先的分布式计算资源优化配置和行业数字化转型。”

与此同时,中国信息通信研究院与PPIO派欧云联合多家行业领军企业、科研机构共同启动《分布式算力发展白皮书》研究工作,旨在推动分布式算力技术的发展,为全球数字经济注入新动能。白皮书将系统地阐述了分布式算力的发展背景、核心技术、应用场景、市场趋势以及未来发展方向,全面总结了近年来分布式算力在全球范围内的实践成果与技术突破,为分布式云行业从业者、技术开发者和政策制定者提供清晰的方向指引,推动分布式算力技术的进一步成熟和落地。

不仅如此,为了推动AI应用的持续创新,PPIO派欧云联合PingCap、Zilliz、AscentStream和CSDN,共同启动“Pioneers AI初创加速计划”。该计划面向AI初创企业和开发者,提供包括分布式算力、分布式关系型数据库、分布式向量数据库、分布式消息队列等在内的全面资源和技术服务,助力初创团队在分布式云上实现快速成长,加速其创新成果的落地。

PPIO派欧云联合创始人、董事长兼 CEO姚欣表示:作为一位二次创业者,走了20年的创业之路,我深知创新的道路并不总是平坦的。我们站在新时代的门槛前,也正在见证一批又一批满怀梦想的开拓者,正如当年那个年轻的姚欣一样,他们需要的不仅仅是资金和技术,更是一份来自同路人、先行者的信任和鼓励,就像我的老师金海教授当年给我指引了前进的方向。致敬新时代的开拓者,让我们一起在新的AI时代,共智创新机遇。

PPIO派欧云将继续依托产学研深度融合与生态体系共建的优势,基于分布式云打造创新产品服务,持续降低技术基础设施成本,使更多AI企业和开发者能够轻松承担大模型推理的费用和成本,助力企业在AI应用创新中抢占市场先机。