对话PPIO CTO王闻宇:推理爆发前夕,从GPU发展角度看AIGC大时代的来临

随着推理创新应用的落地开花,GPU作为一种强大的计算工具,正在引领着这场数字化世界的变革。其卓越的高性能计算能力和并行处理能力为AIGC技术的发展提供了强大支持,推动了音视频内容的创新与进步。

从GPU发展角度看AIGC大时代的来临

1.LiveVideoStack:王闻宇老师您好,非常高兴再次邀请到您参与采访。在上海站,您参与了【AIGC与内容生产】专题并分享了精彩的演讲,您参与其中的感受如何?有没有特别令您印象深刻的亮点或观众的提问?

王闻宇:上次活动我演讲结束后,问问题的朋友非常多,很火爆,我感受到咱们大会的观众非常热情。上海站我分享的是“AIGC音视频工具分析和未来创新机会思考”这个话题,主要分析了 AIGC 与音视频的关系,并且站在全球视野,给大家分享了一些知名国外的音视频应用或App,以及他们所背后的前沿技术(详情可查看:《AIGC音视频工具分析和未来创新机会思考》)。

印象里,当时大家对于AI和 AIGC话题的关注度都非常高,但很多朋友对音视频行业在国外发展和一些前沿技术动态是不太熟悉的。最近不一样了,随着大家关注度的提升,国内的很多像字节、美图等头部公司都已经开始积累相关的产品了。

上海站印象最深的一个话题是,国内跟国外的AIGC的发展差距到底有多远?

从目前来看,国内AIGC与国外相比差距还比较大。本质上看,虽然行业内很多论文都是国内的学校和机构提出的,但是一些革命性的技术和应用往往都出自于国外,比如Transformer、Diffusion、VideoDiffusion、NeRF等模型......这些革命性技术都是海外的公司和机构推出的,看不到华人的署名。而国内的学校和机构,更善于做些优化和补充,真正的硬核的底座技术不够。

从产业创新角度看,国外的AIGC应用和App如雨后春笋般的喷涌而出,而且很多都还是几个人或者十几个人的小公司做出来的,这对比国内要踊跃很多。当然,国内因为众所周知的原因,相对来说没有那么活跃。

这方面,我给国内开发者的建议是,可以考虑做出海的产品,在国外把产品的核心逻辑验证通过,再复制到国内。也提醒一下开发者,在国内发布Web和App务必要注意合法合规,数据安全。

当然,我也相信国内外的AIGC发展差距并不是固定的,随着国内在人工智能技术发展、人才培养、政策支持等多方面环境的变化,相信国内的行业发展和创业环境也会越来越好。

2.LiveVideoStack: 我们知道您对技术环境的变化非常敏锐,可以分享一下是什么契机让您选择了GPU作为深圳站演讲的话题?在这个话题上,您有哪些特别的见解想要与大家分享?

王闻宇:为什么要讲GPU?跟 4月份不一样的是,我发现当前推理创新的App、场景,落地的已经越来越多了。而训练到一阶段之后,推理必然会形成一个爆发,甚至我认为我们就处于推理爆发的前期。

随着推理类应用的爆发,我认为未来的应用对推理的成本要求会越来越高。推理的产品要起来,必然要把其成本降到今天 1/ 10 甚至 1/100,就像之前CDN也经历了这个降本的过程。另外推理一旦发展起来,必将产生大规模用量的GPU需求。此时如何选好GPU,怎么用好 GPU ,怎么针对 GPU 的一些特点做优化,进而影响推理成本,是个非常值得探讨的话题。

至于这方面有什么特别的见解,当然有。不过这里我要卖个关子,我的演讲“AIGC基石思考之算力哲学——论GPU的过去、现在和未来”,将在11月25日下午2点 深圳·圣淘沙酒店 翡翠三厅(A), 深圳站大会上分享,有兴趣的话,欢迎届时大家来现场一起交流。

3.LiveVideoStack: 在您看来,GPU在当今数字化世界中扮演着怎样的关键角色?它在推动元宇宙、AIGC等领域的贡献是怎样的?您能分享一些实际案例或应用场景吗?

王闻宇:我认为就像水、电、气、煤一样,GPU可以说是当今数字化进程中的核心生产资料。

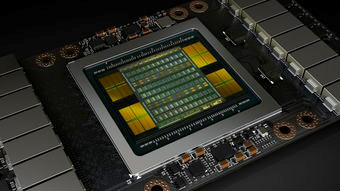

GPU已成为元宇宙、人工智能、大语言模型、AIGC发展的必备基础设施之一。我曾经在去年的 LVS大会上分享过一个话题叫PPIO:探讨元宇宙基础设施建设及在云游戏的实践和思考。当时讲到元宇宙的发展中要怎样串流时,已经推演了串流一定是GPU在云端做渲染,这其中,GPU 起到非常核心的作用。另外,GPU计算也是所有 AI 的基石,AIGC 的发展基本也都是建立在 GPU 提供的算力之上的。这也是为什么英伟达能成为万亿级市值的公司,且其市值能基本大于因特尔、AMD、高通三大芯片巨头的总和的原因。

4.LiveVideoStack: 在您的观点中,GPU的发展历程中有哪些关键时刻和技术突破?

王闻宇:GPU技术发展了差不多有 30 年的历史,从软硬件上,都有各种各样的突破,包括图形、 矩阵计算、编解码,可以聊的话题非常多。这次演讲中,我会从过去、现在、未来三个时间线为大家做一个梳理,内容包含GPU的起源和历史、GPU硬件技术的迭代、从3D渲染到神经网络、再到 LLM,AIGC应用,以及GPU的的关键架构,参数以及算力的工程优化思考等等。欢迎大家届时来看!

5.LiveVideoStack:GPU云技术作为一个新兴领域,对于全球GPU产业有着重要意义。您认为GPU云的发展将带来哪些改变?GPU云与传统的CPU云相比,有哪些独特的特性?

王闻宇:GPU云用量的高速增长,必然是一个趋势,我预测未来5年后,它的用量、规模,预算都会比基础云计算还要大得多。但GPU云有个不一样的特点,它可能没有传统云计算的标准化,它更加异构(机型、卡型组合多)。GPU 非常昂贵,而且不同的场景对 GPU 的要求和选择也不一样,训练和推理还有很大的不同。所以我的看法是未来不会有某一款GPU,能够最高性价比的解决各行各业的所有需求,可能每一类需求都会有一个最佳机型方案。

另外,最近英伟达禁令、卡脖子的事情,引起了大家的热议。在这件事上我是觉得有利有弊吧。

我非常坚信,这个卡脖子,短期看是不利的,但长期看,对于我国的发展是很有利的。短期内咱们可以受些委屈,但下一步,我预计国家有可能会拿出像当年扶持新能源车产业链一样的力度,来扶持国产的GPU。5-10年之后,相信我们能完全解决芯片卡脖子的问题。关于如何应对卡脖子的话题,我在会上会多分享一些观点。

6.LiveVideoStack:这些特性可能给PPIO派欧云的技术团队带来怎样的挑战和机遇?

王闻宇:PPIO作为中国领先的独立边缘云服务提供商,在全国30多个省,1000 多个县市及区域,为客户提供符合低时延、高带宽、海量数据分布处理需求的边缘云计算服务和解决方案。我认为在GPU 云发展这侧,PPIO的优势还是做分布式、以及异构的特点。这个模式在推理这个领域可以赋能很多场景,因为异构的这种能力,本身就能够给 GPU 带来很好的跟技术中心之间的补充。